Introduction

Data Acquisition Strategies in Agricultural Environments

Visible Spectrum-based Approaches

Non-Visible Spectrum-based Approaches

Computer Vision Algorithms for Agricultural Applications

2D Detection & Segmentation

3D Perception & 6D Pose Estimation

Quality, Grade, and Maturity Estimation

Model Lightweighting and Optimization

Key Limitations and Future Research Directions

Key Limitations of Current Research

Future Research Directions

Conclusion

Introduction

전 세계 농업은 인구 구조 변화와 노동력 부족이라는 공통된 도전에 직면해 있다. 이에 따라 대한민국 농업을 둘러싼 대내외 환경은 또한 급속히 변하고 있다. 통계청의 장래인구추계에 따르면 대한민국 총인구는 2020년을 정점으로 장기 감소 국면에 진입했으며, 인구성장률 역시 감소세를 이어갈 전망이다. 농촌의 고령화 문제는 특히 심각하다. 인구구조 변화는 노동력 확보의 문제를 넘어 가구구조와 소비에도 연쇄적 변화를 일으킨다. 한국농촌경제연구원(KREI)의 분석에 따르면, 식품기업 전문가들은 노동력 감소에 대비한 ‘인력 대체 기술’의 확보를 가장 시급한 과제로 꼽고 있다(Park et al., 2024).

스마트 농업의 근간을 이루는 정밀농업(Precision Agriculture)은 경작지 내 토양과 작물 요인의 공간적·시간적 가변성(spatiotemporal variability)을 정량적으로 인지하고 관리하는 것을 핵심 원칙으로 삼는다(Stafford, 2000). 이는 19세기 후반 농업의 확대·집약·기계화 과정에서 일반화된 획일적 관리(uniform management) 방식, 즉 필지 전체에 동일한 처방을 일괄 적용하던 관행과 근본적인 차이를 보인다. 정밀농업은 ICT, 센서, 위치정보 및 데이터 분석 기술을 통해 과거에는 불가능했던 미시적 단위의 가변성 관리를 복원하고, 이를 통해 저투입·고효율의 지속가능한 농업으로의 패러다임 전환을 추구한다(Zhang et al., 2002).

스마트농업은 정밀농업의 원칙을 ICT 기술과 결합하여 한 단계 발전시킨 ‘농업 4.0(Agriculture 4.0)’의 핵심 개념이다. 정밀농업이 필지 내 ‘가변성’을 인지하고 관리하는 데 중점을 둔다면, 스마트농업은 여기에 사물인터넷(IoT) 센서, 네트워크, 클라우드, 인공지능(AI), 로봇 기술을 유기적으로 융합하여, 데이터 수집부터 분석, 의사결정, 실행에 이르는 전 과정을 실시간으로 자동화하고 지능화하는 것을 목표로 한다. 실제로 2010년대 이후 관련 연구가 급증한 배경에는 하드웨어의 발전, 통신 인프라의 고도화, 그리고 빅데이터 및 AI 기술의 성숙이 핵심 동력으로 자리 잡고 있다. 궁극적으로 스마트농업은 단순히 노동력을 대체하는 기계 도입을 넘어, 농업 생태계 전반을 데이터에 기반하여 재설계하는 ‘지능형 운영체제(Intelligent Operating System)’를 구축하는 것에 가깝다. 토양, 기후부터 시장 데이터까지 통합 분석하여, 필지 단위의 가변 처방부터 산지 유통의 품질 관리에 이르는 전 과정을 지능화하는 것이 핵심이다(Navarro et al., 2020).

이렇게 농업 전반에 스마트 기술 도입이 확산되고 있음에도 불구하고, 국내 원예 분야의 ‘수확’과 ‘선별·포장’은 여전히 고질적인 노동 집약적 공정으로 남아 있다. 시설 자동화로 다른 단계의 노동 투입은 감소했지만, 과채류 생산에서 가장 많은 인력이 단기간에 집중되는 이 두 단계의 작업 비중은 줄지 않거나 오히려 증가하는 경향이 조사된다(Hwang et al., 2011). 수작업에 의존하는 수확은 최적기를 놓쳐 품질 저하와 손실을 야기하며, 장시간 반복 작업은 작업자의 피로 누적으로 효율과 정확도를 저하시킨다. 선별 과정 역시 작업자의 주관과 피로에 따른 편차가 발생하여 품질의 일관성을 유지하기 어렵다. 따라서 이러한 노동 집약적 공정인 수확과 선별·포장 로봇·자동화 시스템의 도입은 노동 의존도를 낮추고, 생산 효율과 품질 균일성을 동시에 달성하는 핵심 과제이며, 이는 정부가 추진하는 ‘스마트농업’을 실현하기 위한 초석이 될 것이다.

이러한 수확 및 선별 공정의 자동화는 기계에 ‘정확히 보고 판별하는 능력’을 부여하는 데 달려 있다. 이 역할을 수행하는 핵심 기술이 컴퓨터 비전(Computer Vision)이며 이는 카메라와 광학 센서로 취득한 영상을 딥러닝 알고리즘으로 해석하여 작물의 위치, 크기, 결함 등 다차원적 특성을 정량화할 수 있다. 이를 통해 작물 성숙도 판단, 결함 검출, 등급 분류, 수확 로봇의 목표 인식 및 경로 계획 등 핵심 기능을 가능하게 한다. 나아가 다분광·초분광 영상 기술은 가시광선(RGB)을 넘어, 인간의 눈으로는 식별이 불가능한 당도, 수분, 초기 부패와 같은 화학적·생리적 상태까지 비파괴적으로 정밀 진단할 수 있다. 이러한 컴퓨터 비전은 농업 자동화에서 지능형 눈의 역할을 하며, 공정 전반의 판단을 데이터화 및 규격화하는 주요한 기술이다.

본 논문은 농업 자동화의 핵심 단계인 ‘수확’과 ‘선별’ 공정에 적용되는 컴퓨터 비전 기술의 최신 동향을 체계적으로 정리하는 것을 목적으로 한다. 이를 위해 2024년부터 2025년까지 Springer, MDPI, Elsevier 등 주요 학술 데이터베이스에 게재된 최신 연구들을 바탕으로, 2장에서는 데이터 수집 기술을, 3장에서는 객체 탐지, 3D 인식, 품질 판정, 모델 경량화 등 핵심 알고리즘을 검토한다. 마지막으로 4장에서는 전체 내용을 요약하고 향후 연구 방향을 제시하고자 한다.

Data Acquisition Strategies in Agricultural Environments

농산물 수확 및 선별 자동화 시스템의 성능은 대상 작물을 얼마나 정확하게 인식하고 그 공간적 위치를 파악하는지에 달려있다. 이는 단순히 작물의 존재 유무를 확인하는 것을 넘어, 작물의 품질, 숙성도 등을 식별하는 표현학습과 로봇의 효율적인 수확 작업 경로 계획에 필수적인 정보인 3차원 좌표 및 자세 추정을 제공하는 핵심적인 첫 단계이다. 특히 노지 및 온실 환경의 작물은 광택성 표면, 잎이나 지지대로 인한 빈번한 폐색(occlusion), 시시각각 변하는 자연광, 그리고 작물 자체의 형태적 비정형성 등 예측 불가능한 관측 조건을 가진다. 이에 컴퓨터 비전 시스템의 눈 역할을 하는 센서 기술은 점차 발전해왔으며 농업에 적용되었다. 크게 가시광선 영역을 포착하는 RGB 센서, 3차원 공간 정보를 추가로 제공하는 RGB-D 센서, 그리고 인간의 시각적 한계를 넘어 화학적 및 생리적 특성까지 분석하는 비가시광 영역을 얻을 수 있는 다분광 및 초분광 센서로 구분할 수 있다.

Visible Spectrum-based Approaches

RGB Sensor

RGB(Red, Green, Blue) 센서는 저비용, 고해상도, 그리고 넓은 하드웨어 생태계 덕분에 농업 컴퓨터 비전 연구에서 사실상의 표준으로 기능한다. 가시광선 스펙트럼(약 400-700 nm) 대역의 전자기파를 적색, 녹색, 청색의 세 가지 기본 채널로 분해하여 그 강도를 정량적으로 측정하는 가장 보편적인 형태의 광학 이미징 장치로 이미지의 각 화소(pixel)는 세 채널에 대한 강도 값의 조합으로 정의되며, 이를 통해 광범위한 색상 스펙트럼을 디지털 방식으로 재현할 수 있다. 이러한 데이터가 제공하는 풍부한 색상, 형태, 텍스처 정보는 객체 탐지, 분할, 그리고 외관 기반 등급 분류 알고리즘의 핵심 입력 신호로서 활용할 수 있다. 그러나 이러한 시각 정보의 일관성과 신뢰성은 조명, 배경, 반사와 같은 외부 환경 요인에 매우 민감하게 반응하여 데이터의 품질을 저해할 수 있다. 따라서 정확한 작물 특성 추출과 이미지 품질의 일관성을 확보하기 위해, 연구 및 검증 단계에서 라이트박스, 암실 또는 통제 온실을 구축하여 조도, 반사, 배경을 규격화하는 접근이 사용된다(Al-Sammarraie et al., 2025; Basak et al., 2025; Loarca et al., 2024; Shanthini et al., 2025). 온실 외 환경을 모사하거나 배경 간섭을 줄이기 위해 검정, 흰색 및 녹색의 단색 배경(Monochromatic Background)을 사용하며, 표면 결함을 고감도로 분리하기 위해 파란색 배경을 선택하기도 한다(Gogoi and Valan, 2025; Goh et al., 2025; Islam and Islam, 2025; Ulu et al., 2025). 조명은 할로겐 및 LED가 주로 사용되며, 그림자와 하이라이트를 완화하기 위해 45도 대칭 배치, 반사 직물, 확산 돔 또는 박스를 활용한다(Rezaei et al., 2024; Shanthini et al., 2025; Ulu et al., 2025). 데이터 획득에는 Canon, Sony, Nikon 등의 DSLR 및 미러리스 카메라부터 Hikvision, Dahua와 같은 고성능 산업용 카메라, 그리고 스마트폰, Raspberry Pi 카메라 모듈에 이르기까지 다양한 장비가 사용된다(Table 1). 이미지 해상도는 640×480 픽셀의 저해상도부터 7952×5304 픽셀의 고해상도까지 응용 분야에 따라 다양하게 설정된다(Ait Ameur et al., 2025; Bu et al., 2025; Mydhili et al., 2025; Ulu et al., 2025). 나아가 데이터의 정량적 정확도를 높이기 위해, 이미지 내 크기 보정을 위한 스케일 마커나 색상 보정을 위한 컬러 레퍼런스 카드(X-Rite ColorChecker)를 작물과 함께 촬영하여 후처리 과정에서 데이터의 신뢰도를 확보하는 연구도 수행되었다.

이러한 기술적 설정 하에서 RGB 기반 연구는 다양한 작물의 품질 평가 및 상태 모니터링에 광범위하게 활용되고 있다. 과일류에서는 사과의 표면 멍/결함 탐지(Hou et al., 2024), 오렌지/감귤의 숙도 판별 (He et al., 2025b), 딸기의 수확 적기 판단 (Chen et al., 2024b), 블루베리의 성숙도 분류(You et al., 2025a), 망고의 등급 분류(Kalaiselvi, 2025), 크랜베리의 숙성 특성 정량화(Loarca et al., 2024), 토마토의 외관 품질 평가(Noorali et al., 2025) 등 작물별 특성에 맞는 다양한 분석이 이루어지고 있다. 이러한 연구들은 공통적으로 RGB 이미지로부터 추출되는 색상, 형상, 텍스처 정보를 기반으로 하여 각 작물의 품질 지표를 정량적으로 산출하는 것을 목표로 한다.

그러나 이와 같은 통제된 환경 기반 접근법은 실제 농업 현장에서 마주하는 근본적인 난제를 해결하는 데 명백한 한계가 존재한다. 유리온실 및 노지 환경에서는 시간대, 기상 조건, 차광막의 개폐 여부에 따라 조도의 세기와 색온도(Color Temperature)가 급격하고 비선형적으로 변동한다(Jain et al., 2025). 또한, 대부분의 과실 표면에 존재하는 왁스층(Waxy Cuticle)은 정반사(Specular Reflection)를 유발하여 이미지 센서의 특정 픽셀을 포화(Saturation)시키고, 해당 영역의 고유한 색상 정보를 소실시킨다(Mojaravscki and Graziano Magalhaes, 2024). 이는 과실의 숙성도를 색상에 기반하여 판단하는 알고리즘의 신뢰도를 심각하게 저해하는 요인이다. 나아가, 잎, 가지, 그리고 인접한 과실에 의해 발생하는 복잡한 폐색은 탐지 대상의 외형적 경계를 분절시키며, 밀집된 군집 형태로 성장하는 작물은 개별 객체의 고유한 형상 특징을 식별하는 것을 어렵게 만든다. 이처럼 RGB 센서가 제공하는 외관 정보에 대한 의존성은, 조작 가능한 변수들을 통제할 수 있는 실험실 환경과 달리, 예측 불가능한 변수가 지배하는 실제 현장에서는 그 성능이 급격히 저하되는 결과를 초래할 수 있다(Chen et al., 2025a). 결국, RGB 센서는 비용 효율성측면에서는 여전이 필수적인 기반 기술이지만 고차원적인 과업을 최종적으로 보증하기에는 정보의 차원이 근본적으로 부족하다. 이러한 정보의 한계를 극복하기 위한 3차원 인지 및 스펙트럼 분석 기술은 필수적인 보완 축으로서 연구된다(Li et al., 2025b).

Table 1.

Summary of camera models and target crops in related studies.

| Camera model | Target crop | Reference | |

| Canon | PowerShot G16 | Apple | Yan et al. (2025a) |

| EOS 90D | Orange | He et al. (2025b) | |

| EOS REBEL T6 | Cranberry | Loarca et al. (2024) | |

| EOS 80D | Apple | Zhai et al. (2025) | |

| Sony | Alpha 5100 | Cabernet Sauvignon | Wang et al. (2025c) |

| A550 | Strawberry | Chen et al. (2024b) | |

| Alpha 6000 | Apple | Hobart et al. (2025) | |

| α7R IV | Grape | Li et al. (2025c) | |

| Hikvision | MV-CA032-10GC | Orah | Bu et al. (2025) |

| Casio | EX-ZR5000 | Tomato | Wang et al. (2025e) |

| Phone | iPhone 15 Pro | Blueberry | You et al. (2025a) |

| iPhone 14 | Blueberry | Yu et al. (2025) | |

| Arducam | IMX477 | Strawberry | Liu et al. (2025c) |

RGB-D Sensor

수확 로봇의 조작 관점에서, 2차원 RGB 이미지만으로는 목표 객체의 정확한 3차원 공간 좌표(x,y,z), 표면의 법선 벡터(Surface Normal Vector) 및 곡률, 그리고 로봇 그리퍼(Gripper)가 접근해야 할 줄기나 절단점의 접근 벡터(Approach Vector)를 안정적으로 산출하기 어렵다(Hwang et al., 2024; Ni et al., 2024). 이러한 한계를 극복하기 위해 깊이 정보(Depth)를 획득하는 ToF (Time-of-Flight), 구조 광(Structured Light), 스테레오 비전(Stereo Vision) 기술이 도입되었다. 이들을 통칭하는 RGB-D 센서는 전통적인 RGB 컬러 이미지와 함께 각 픽셀에 대한 깊이(Depth) 정보를 동시에 제공하는 센서 기술이다. 2차원 시각 정보와 3차원 공간 정보를 결합함으로써, 작물의 위치, 크기, 형태뿐만 아니라 주변 환경과의 공간적 관계를 보다 정밀하게 파악할 수 있게 한다(Chen et al., 2024a; Dai et al., 2025b; Z. He, Z. Liu, et al., 2025; Jin et al., 2025; Kang et al., 2025; Lang et al., 2025; Qin et al., 2025; Shen et al., 2025).

ToF센서는 능동적(Active) 깊이 측정 방식으로, 자체 광원에서 변조된 근적외선(NIR)을 방출한 뒤, 대상 표면에서 반사되어 돌아온 빛의 위상 지연(Phase Shift)이나 직접적인 비행시간을 측정하여 거리를 산출한다. 이 원리 덕분에 ToF는 대상의 색상이나 텍스처 변화에 거의 영향을 받지 않으며, 높은 프레임률로 깊이 맵을 생성할 수 있어 실시간성이 매우 중요하다(Guan et al., 2025; Zhang et al., 2025b). 하지만, 야외의 태양광은 ToF 센서가 사용하는 근적외선 대역의 강력한 노이즈 소스로 작용하여 야외 환경에서 신호 대 잡음비(Signal-to-Noise Ratio, SNR)를 급격히 저하시킨다(Gimpelj and Munih, 2025). 또한, 반투명한 조직(포도)이나 광택이 심한 표면에서는 빛이 여러 경로를 통해 센서로 돌아오는 다중 경로 간섭(Multipath Interference, MPI) 현상이 발생하여 깊이 측정값에 양의 편향(Positive Bias)을 초래할 수 있다(Freedman et al., 2014).

구조 광(Structured Light) 방식 역시 능동적 방식으로, 프로젝터를 이용해 사전에 설계된 특정 패턴(격자, 사인파, 이진 코드)의 빛을 장면에 투사한다. 이후 카메라로 대상의 3차원 형상에 의해 왜곡된 패턴을 촬영하고, 이 왜곡 정보를 분석하여 픽셀 단위의 깊이 정보를 복원한다(Miyashita et al., 2025). 구조 광은 텍스처가 전무한 매끄러운 표면에서도 매우 정밀하고 고밀도의 3D 포인트 클라우드를 생성할 수 있다는 독보적인 장점을 가진다. 그러나 외부 광원의 간섭에 매우 민감하여 통제된 실내 환경에 주로 적합하며, 프로젝터와 카메라 간의 정밀한 기하학적 캘리브레이션이 필수적이다(Chen et al., 2025b; Jia et al., 2024). Li등, Zhu등은 선형 편광판(Linear Polarizer)을 광원과 카메라에 교차 배치하여 표면의 정반사를 효과적으로 억제함으로써, 배나 사과의 미세한 멍(Bruise)이나 표면 아래의 결함을 탐지하는 데 성공적으로 적용된 바 있다(Li et al., 2025a; Zhu et al., 2024a).

스테레오 비전(Stereo Vision)은 인간의 양안 시각 원리를 모사한 수동적(passive) 깊이 측정 방식이다(Mu et al., 2024). 사전에 정밀하게 캘리브레이션된 두 대 이상의 카메라로부터 동기화된 이미지를 획득하고, 두 이미지 간의 시차(disparity)를 삼각 측량 원리(Triangulation)에 따라 깊이로 변환한다(Conejero et al., 2025). 이 방식의 핵심 계산 과정은 좌우 이미지에서 동일한 물리적 지점에 해당하는 픽셀 쌍(Correspondence)을 찾는 ‘스테레오 정합(Stereo Matching)’ 문제로 귀결된다(Tosi et al., 2025). 주요 장점으로는, 고해상도의 산업용 카메라를 사용할 수 있어 근거리에서 작물의 미세한 형상까지 정밀하게 포착할 수 있다는 점을 꼽을 수 있다. 또한, 외부 광원을 사용하지 않으므로 ToF나 구조광 센서가 태양광에 의해 겪는 직접적인 신호 간섭 문제에서 비교적 자유롭다. 그러나 태양광의 직접적인 신호 간섭은 없지만 강한 직사광선은 오히려 이미지 센서를 과포화(saturation)시켜 질감 정보를 소실시키므로, 정밀한 노출 제어가 뒷받침되지 않으면 성능이 급격히 저하한다(Kazmi et al., 2014). 또한 알고리즘의 원리상 표면에 텍스처가 부족하거나 반복적인 패턴이 존재하면 정확한 대응점을 찾지 못해 정합 오류(Mismatches)가 발생하고, 이는 깊이 정보의 노이즈나 구멍(Holes)으로 이어진다. 마지막으로, 카메라 간의 거리인 베이스라인(Baseline), 시야각(Field of View), 초점 거리 등의 기하학적 제약은 시스템의 자유도를 제한하는 요인으로 작용한다.

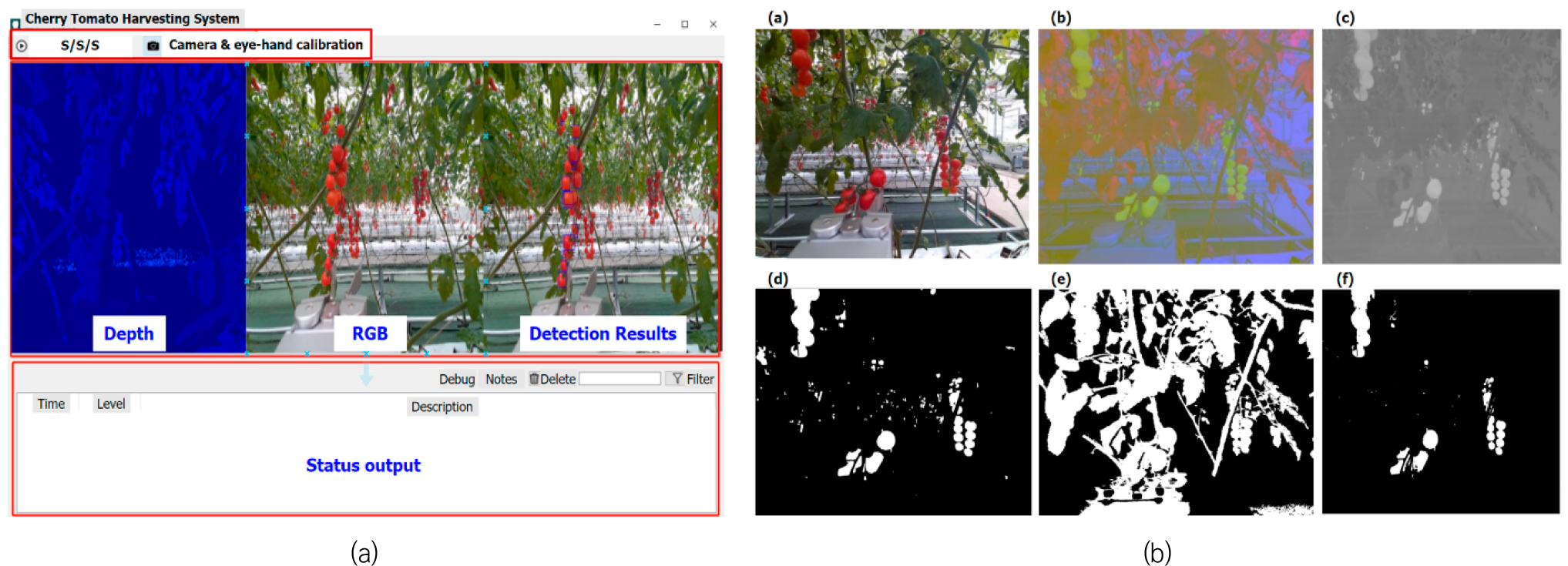

이러한 RGB-D 센서는 특정 응용 시나리오에 따라 상호 배타적인 장단점을 지닌다. 야외 환경에서의 수확 및 탐색 과업에는 상대적으로 외부광에 강건한 스테레오 비전이, 고속 컨베이어 벨트 위에서의 객체 위치 추정이나 실시간 장애물 회피에는 ToF가, 그리고 고정된 위치에서 수행되는 정밀 형상 계측이나 내부 결함 동시 검출에는 구조 광 방식이 각각 비교 우위를 가진다. 관련 문헌에 보고된 주요 시스템의 제원과 연구 대상 작물은 Table 2와 같다. 실제 현장에 배치되는 로봇 시스템에서는 RGB-D 형태 혹은 고화소의 RGB센서를 추가로 결합한 멀티모달 방식이 보편적으로 채택된다. 이러한 구성에서, RGB 이미지를 통해 얻어진 2D 객체 탐지 및 분할 결과는 3D 포인트 클라우드 상에서 해당 객체 영역을 분할(Point Cloud Segmentation)하고, 최종적으로 로봇 조작에 필요한 6자유도 자세(6D Pose)를 추정하는 데 필요한 정보로 활용된다. 일반적으로 활용되는GUI와 RGB–D 전처리 파이프라인은 Fig. 1과 같다.

Fig. 1.

System GUI and initial RGB–D ROI pipeline (Cai et al., 2024b). (a) Operator GUI for the harvesting robot; S/S/S denotes Start/Stop/Settings with live RGB-D stream, sensor status, and logging. (b) ROI pipeline: RGB → Lab conversion → single Lab channel (e.g., a) → color-based binary mask → depth mask → fused color–depth ROIs.

Table 2.

Summary of 3D imaging systems and applications in agricultural studies.

| Depth technology | Camera model | Application | Reference |

|

Active stereo RGB-D |

Intel RealSense D435i | Tomato | Dai et al. (2024) |

| Li et al. (2024b, 2024c) | |||

| Dragon Fruit | Yuan et al. (2025) | ||

| Asparagus | Zhang et al. (2025a) | ||

| ZED2i | Strawberry | He et al. (2025d) | |

| Tomato | Li et al. (2024b, 2024c) | ||

| ZED2 | Strawberry | Tituaña et al. (2024) | |

|

Intel RealSense D457 | Grape | Yang et al. (2024) | |

| LiDAR (ToF)RGB-D | Intel RealSense L515 | Tomato | Wang et al. (2025d) |

| ToFRGB-D | Azure Kinect DK | Vineyard (Grape) | Zhao et al. (2024) |

| Maizeleaf | Niu et al. (2025) | ||

| Structured-light | DLPLCR4500LVM + Grasshopper3 | Apple, Tomato | Naqvi et al. (2025) |

|

MER2–507–23GC + HN-1216–5 M-C2/3X + DLi CEL5500 | Apple | Yu et al. (2024) | |

|

DLP4500 + MV-CA050–10GM | citrus | Cai et al. (2025) |

Non-Visible Spectrum-based Approaches

Hyperspectral Imaging, HSI

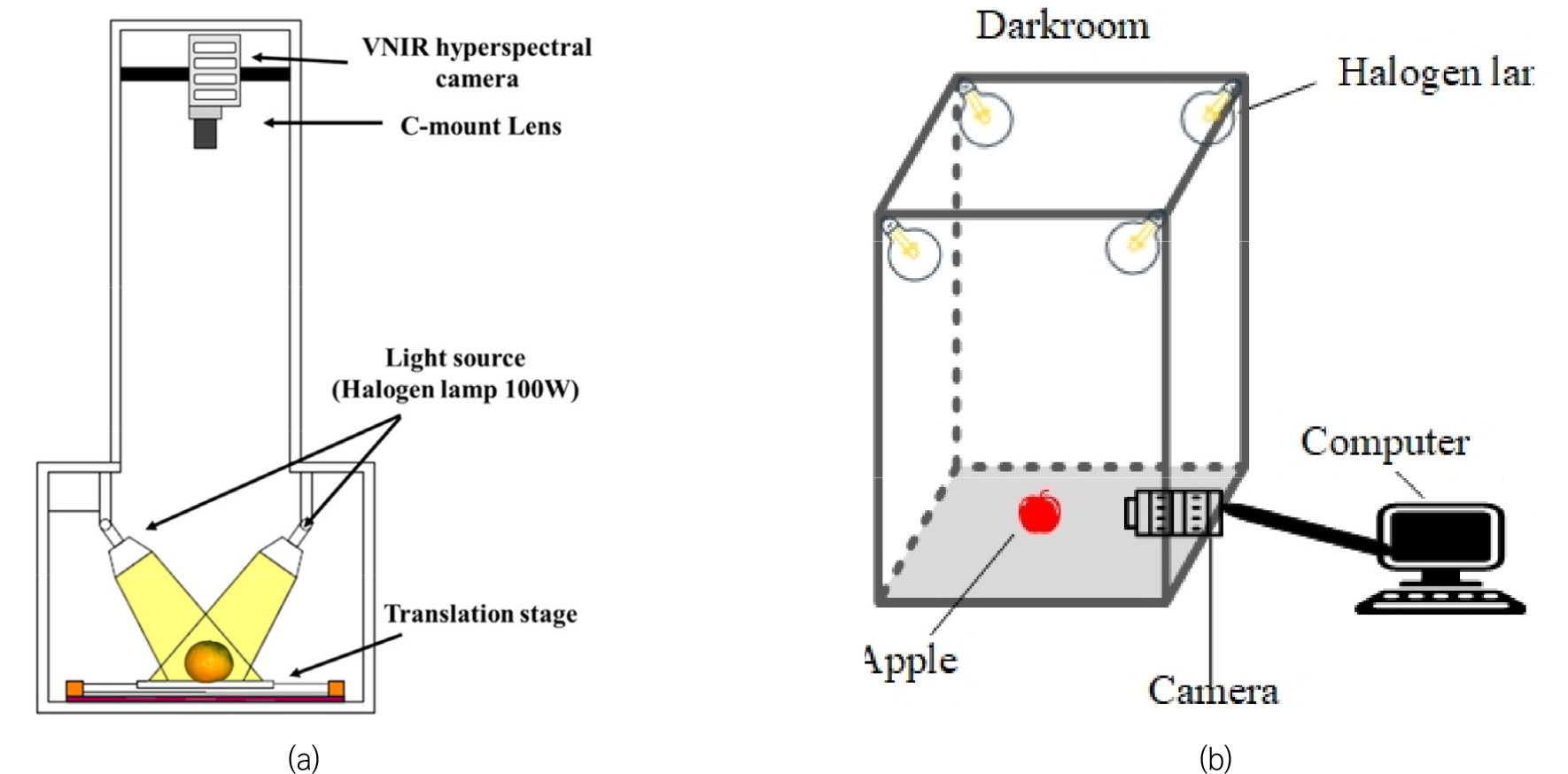

초분광 이미징(Hyperspectral Imaging, HSI)은 수십에서 수백 개에 이르는 매우 좁고(1-10 nm) 연속적인 스펙트럼 밴드(Band)에서 반사 또는 투과 강도를 측정하여 3차원 데이터 큐브(x, y, λ)를 생성한다(Kim et al., 2024). 이 데이터 큐브는 이미지의 모든 픽셀에 대해 완전한 스펙트럼 프로파일(spectral profile or signature)을 가진다. 특정 유기 분자(당, 물, 산)는 근적외선(Near-Infrared, NIR) 및 단파 적외선(Short-Wave Infrared, SWIR) 영역에서 고유한 흡수 대역(Absorption Band)을 가지므로, 픽셀의 스펙트럼 서명을 분석하면 해당 위치의 화학적 조성을 정량적으로 추론할 수 있다(Hou et al., 2024). 이러한 원리를 바탕으로 HSI는 작물 내부의 당도나 산도를 예측하거나, 겉으로 드러나지 않은 초기 단계의 조직 손상을 감지하는 데 탁월한 성능을 보인다(Fu et al., 2025; Yan et al., 2025b). 관련 문헌에 보고된 주요 시스템의 제원과 연구 대상 작물은 Fig. 2, Table 3과 같다.

다만, HSI 원본 데이터는 조명 조건이나 표면 산란 등에 의한 노이즈를 포함하고 있어 분석 전 데이터 전처리(preprocessing) 과정이 필수적이다(Ram et al., 2024). 주로 산란 효과를 보정하기 위한 MSC(Multiplicative Scatter Correction)나 SNV(Standard Normal Variate) 같은 기법이 적용된다(Aline et al., 2025). 전처리가 완료된 HSI 데이터를 분석하기 위해서는 부분 최소 자승 회귀(Partial Least Squares Regression, PLSR)와 같은 다변량 통계 분석 기법이나(Aline et al., 2025), 스펙트럼 정보를 직접 입력으로 받는 1D-CNN(Convolutional Neural Network) 또는 3D-CNN 기반의 딥러닝 모델이 활발히 활용된다(Lyu et al., 2025).

이러한 기술적 특성을 바탕으로 HSI는 다양한 작물의 내부 품질 평가에 광범위하게 활용되고 있다. 토마토의 당도 및 품질 모니터링(Cai et al., 2024a), 감귤의 당도 및 엽록소 추정(Kim et al., 2024), 복숭아의 당도·경도·수분 예측, 사과·배의 곰팡이핵 및 멍 조기 탐지(Zhai et al., 2025), 블루베리의 성숙도 및 결함 판정(Fu et al., 2025) 등 작물별 특성에 맞는 다양한 분석이 이루어지고 있다. 이러한 연구들은 일반적으로 산란 보정(MSC/SNV) → 유효 파장 선택 → 다변량 분석(PLSR) 또는 딥러닝(1D-CNN/3D-CNN) 순으로 구성되는 분석 파이프라인을 따른다.

Fig. 2.

Schematic of hyperspectral imaging system. (a) VNIR hyperspectral imaging system(Kim et al., 2024), (b) VNIR, SWIR hyperspectral imaging system(Hou et al., 2024).

Table 3.

Overview of hyperspectral imaging technologies for crop analysis.

| Hyperspectral System | Spectral Range (nm) | Acquisition Method | Target Crop | Reference |

| Corning microHSI™ 410 | 400 - 1000 | Line Scanning | citrus | Kim et al. (2024) |

| ImSpector/Specim V10E | 400 - 1000 | Line Scanning | Tomato | Polder et al. (2024) |

| Isuzu Optics portable | 400 - 1000 | Line Scanning | Tomato leaf | Gao et al. (2025) |

| BV-C2901-GE | 950 - 1700 | - | Apple | Hou et al. (2024) |

| MER-530-20GM-P NIR | 300 - 1100 | - | ||

| HySpex VNIR | 404 - 994 | Line Scanning | Bell pepper | Krüger et al. (2024) |

| HySpex SWIR | 954 - 2511 | Line Scanning | ||

| Specim | 400 - 1000 | Line Scanning | Tomato Seed | Kang et al. (2024) |

| Specim-IQ | 400 - 1000 | Line Scanning | Tomato | Fass et al. (2025) |

| Cubert UHD 185 Firefly | 502 - 950 | Snapshot | Cucumber leaves | Mandrapa et al. (2024) |

| Cubert ULTRIS 5 | 450 - 850 | Snapshot | Basil | Yoon et al. (2024) |

Multispectral Imaging, MSI

다분광 이미징(Multispectral Imaging, MSI)은 HSI와 달리, 특정 분석 목적에 최적화된 소수의(3-10개) 불연속적인 스펙트럼 밴드에서만 데이터를 선택적으로 획득한다(Jaywant and Arif, 2024). 예를 들어, 식물의 광합성 활력도를 평가하는 데 가장 널리 쓰이는 정규화 식생 지수(Normalized Difference Vegetation Index, NDVI)는 엽록소가 강하게 흡수하는 적색(Red) 밴드와 세포 구조가 강하게 반사하는 NIR밴드의 반사율 차이를 이용한다(Zhao and Qu, 2024). 이 외에도 식생의 노화나 스트레스 상태에 더 민감한 NDRE(Normalized Difference Red Edge)(Li et al., 2025d), 식생의 수분 함량을 파악하는 데 특화된 NDWI(Normalized Difference Water Index) 등 목적에 맞는 다양한 지수들이 개발되어 활용되고 있다(Bartold et al., 2024). HSI에 비해 스펙트럼 해상도는 현저히 낮지만, 특정 물질의 흡수 또는 반사 특성을 포착하는 데는 매우 효과적이다. 또한, 처리해야 할 데이터의 양이 훨씬 적기 때문에 시스템 구축 비용이 저렴하고 실시간 처리에 유리하다는 명확한 장점을 가진다(Al-Sammarraie et al., 2025; Su et al., 2025).

MSI 기술은 이러한 장점을 활용하여 과수 및 원예 작물의 생리 상태 모니터링에 널리 적용되고 있다. 주요 응용 분야로는 수분 스트레스 감지를 위한 NDWI, 광합성 활력도 및 엽록소 함량 평가를 위한 NDVI/NDRE, 그리고 병해충 피해나 조직 손상 탐지를 위한 맞춤형 밴드 조합 등이 있다(Bartold et al., 2024; Zhao and Qu, 2024). 이러한 지수들은 UAV 또는 고정식 시스템을 통해 실시간으로 수집되어 구획 단위의 의사결정 지원에 활용된다.

Thermal Imaging

적외선 열화상(Thermal Imaging)은 물체가 방출하는 적외선(주로 Thermal Infrared, TIR) 복사 에너지를 감지하여 온도의 공간적 분포를 시각화하는 기술이다(Singh et al., 2024). 이는 빛의 반사율을 측정하는 HSI나 MSI와 달리, 대상 자체의 물리적 상태(온도)에 따른 에너지 방출을 측정한다는 점에서 차이가 있다. 열화상 기술의 핵심적인 응용 분야 중 하나는 식물의 수분 스트레스 감지이다. 식물은 증산작용을 통해 잎의 기공으로 물을 증발시키며 온도를 조절하는데, 수분이 부족하여 스트레스를 받으면 기공을 닫아 증산이 억제되고 잎의 온도가 상승한다(Al-Najadi et al., 2025). 열화상 카메라는 이러한 미세한 온도 차이를 감지하여 가뭄 피해를 조기에 진단하고 정밀 관개(precision irrigation)를 위한 정보를 제공할 수 있다(Paciolla et al., 2025).

열화상 기술은 온도 정보를 활용한 다양한 작물 모니터링 응용에서 그 가치를 입증하고 있다. 주요 출력 지표로는 잎 온도 맵, 잎-대기 온도차(T_leaf - T_air), 작물 수분 스트레스 지수(CWSI) 등이 있으며, 이를 통해 수분 스트레스뿐만 아니라 냉해나 열해와 같은 환경 스트레스, 그리고 기계적 손상으로 인한 조직 이상까지 조기에 탐지할 수 있다(Al-Najadi et al., 2025; Paciolla et al., 2025). 이러한 연구는 정밀 관개 시스템의 피드백 데이터나 품질 이상 모니터링에 직접 적용되어 정보를 제공한다. 열화상 기술의 장비 선택은 측정 목적과 플랫폼에 따라 구분된다. 드론 탑재형 시스템의 경우 DJI Mavic 3T가 내장 열화상 모듈을 통해 라디오메트릭 촬영을 지원하여 대면적 모니터링에 널리 사용되며, FLIR One Pro는 맞춤 거치대를 통해 기존 드론에 탑재 가능한 경량 장비로 활용된다. 지상 정밀 측정에서는 FLIR E6가 근거리 세밀 관찰에, FLIR A655sc와 같은 라디오메트릭 카메라가 블랙바디 기준물을 통한 정밀 보정이 필요한 연구에 사용된다.

Computer Vision Algorithms for Agricultural Applications

2D Detection & Segmentation

객체 탐지는 수확 및 선별 자동화 시스템에서 대상이 되는 특정 작물의 존재 여부와 그 위치를 식별하는 컴퓨터 비전의 핵심 단계이다. 이 단계는 단순히 작물을 분류하는 것을 넘어, 이미지 상에서 각 객체의 경계를 정의하는 바운딩 박스와 클래스 레이블을 동시에 예측한다 (Chen et al., 2025d; Conejero et al., 2025; Fu et al., 2025; Kamat et al., 2025). 그러나 농업 환경은 여러 기술적 한계가 존재한다. 작물의 작은 크기, 잎이나 지지 구조물에 의한 폐색, 제어되지 않는 광원 조건이 야기하는 반사 및 그림자, 그리고 작물과 배경 간의 낮은 색상 대비 등은 탐지 성능을 저해하는 주요 요인으로 작용한다(Khan et al., 2025). 이러한 한계를 극복하기 위해, 최근 연구들은 추론 속도와 정확도 간의 상충 관계를 고려하여 아키텍처를 선택한다. 객체 탐지 알고리즘은 크게 2-Stage Detector와 1-Stage Detector로 나뉘어 발전해왔다. 2-Stage Detector는 정확성에 중점을 두는 반면, 1-Stage Detector는 실시간 처리를 위한 속도에 강점을 가진다. 실시간 처리가 요구되는 응용에서는 YOLO 계열과 같은 경량화된 1-Stage Detector가 주로 채택되며(Khan et al., 2025), 복잡한 배경과 높은 객체 밀도를 갖는 환경에서는 Transformer 기반의 탐지 모델이 강건한 성능을 보이는 것으로 보고된다(He et al., 2025c; Li et al., 2025d; Wang et al., 2025e).

1-Stage Detectors

1-Stage Detector는 영역 제안(region proposal) 단계를 생략하고 단일 신경망 내에서 객체의 경계 상자(bounding box)와 클래스를 동시에 회귀 문제로 풀어내는 아키텍처이다. 이러한 구조적 효율성 덕분에 2단계 탐지기에 비해 월등히 빠른 추론 속도(FPS)를 달성하며, 이는 실시간 반응이 필수적인 농업용 로봇 및 자동화 시스템의 지연 시간 예산(latency budget) 요구사항을 만족시키는 핵심 요인이다(Chen et al., 2025b; Hao et al., 2025; Xu and Lu, 2024) 이러한 1-Stage Detector의 대표 알고리즘인YOLO(You Only Look Once) 계열 알고리즘은 농업 분야에서 표준 아키텍처로 자리 잡았으며(Redmon et al., 2016), SSD(Single Shot MultiBox Detector)와 함께 다양한 연구에서 활발히 선택되고 있다(Dong et al., 2025b; Liu et al., 2025c; Yang et al., 2025a). YOLO는 객체 탐지를 단일 회귀 문제로 재정의하여 실시간 처리를 가능하게 했다. 초기 YOLOv1 모델 이후, 정확도와 속도를 개선한 다양한 후속 버전들이 지속적으로 발표되고 있다(He et al., 2025c; Noorali et al., 2025). SSD는 YOLO와 함께 대표적인 1단계 검출기로, 단일 네트워크를 사용하면서도 다양한 크기와 종횡비의 객체를 효과적으로 탐지하기 위해 다중 스케일 특징 맵을 활용한다. 최근 연구 동향은 주로 백본(Backbone) 네트워크의 경량화, 특징 융합 네트워크(neck)의 효율화, 그리고 탐지 헤드(head)의 소형 객체 탐지 능력 강화에 집중된다. 특히 딸기나 블루베리와 같이 이미지 상에서 수 픽셀에 불과한 작은 객체를 안정적으로 탐지하기 위해, 저수준의 고해상도 특징 맵(P2 feature map)을 활용하는 설계가 강건한 성능을 보인다(Liu et al., 2024a; Shui et al., 2024).

2-Stage Detectors

2-Stage Detector는 R-CNN(Region-based Convolutional Neural Network) 계열로 대표되며, 먼저 객체가 존재할 가능성이 높은 후보 영역을 제안하고, 각 영역에 대해 정밀한 분류 및 위치 보정을 수행하는 2단계 접근법을 사용한다. R-CNN(Girshick et al., 2014)과 Fast R-CNN(Girshick, 2015)을 거쳐, Faster R-CNN(Ren et al., 2015)은 Region Proposal Network의 도입으로 정확도 및 속도를 크게 높혔다. 이 방식은 구조적으로 더 많은 연산을 요구하기에 1-Stage 방식보다 추론 속도가 느리지만, 일반적으로 더 높은 탐지 정확도를 제공한다. Hou 등은 사과의 초기 미세한 멍을 탐지하기 위해 개선된 Faster R-CNN 모델을 제안하여 그 잠재력을 검증하였다(Hou et al., 2024). 그러나 대부분의 농업 응용 연구에서는 2단계 검출기의 높은 계산 비용으로 인해 실시간 배포가 제한적이므로(Ariza-Sentis et al., 2024), 주로 경량화된 1-Stage모델의 성능을 비교 검증하기 위한 벤치마크(benchmark)로 활용되는 경향이 있다. Yuan 등은 경량 1단계 검출기 모델인 YOLOv10n-CGD의 성능을 입증하기 위해, SSD, YOLO 계열 모델 등 여러 주류 모델과 함께 Faster R-CNN을 비교군으로 설정했고, Xifeng 등은 TPS-YOLO 모델의 인스턴스 분할 성능을 검증하기 위해, 주류 분할 네트워크인 Mask R-CNN, YOLACT 등과 비교 실험을 수행했다(Liang et al., 2025; Yuan et al., 2025).

Transformer

CNN 기반 아키텍처의 국소적 수용 영역(local receptive field)이라는 본질적 한계를 넘어, Transformer 아키텍처는 이미지 전체의 전역적 문맥(global context)과 장거리 의존성(long-range dependency)을 효과적으로 모델링하는 능력에서 강점을 보인다(Dong et al., 2025a; Zhu et al., 2025). 이는 특히 객체가 밀집되어 있거나 심한 폐색으로 인해 부분적인 정보만 주어졌을 때, 주변 맥락을 통해 객체를 추론하는 데 매우 유리하게 작용한다. 이러한 특성 덕분에 Deformable DETR, DINO와 같은 Transformer 기반 모델들은 복잡한 농업 환경에서 높은 탐지 성능을 보이는 비교 모델로 꾸준히 활용되고 있다(Dai et al., 2025a; Liu et al., 2025a). 최근에는 언어 모델과 비전 모델을 결합한 Vision-Language Model이 농업 분야에 도입되며 새로운 가능성을 제시한다. 대표적으로 Grounding-DINO 모델은 Swin-Transformer를 백본으로 사용하며, "ripe blueberries"와 같은 텍스트 프롬프트(text prompt)를 함께 입력받아 탐지를 수행한다(Mullins et al., 2024). 이는 단순히 고정된 클래스를 분류하는 것을 넘어, 언어적 특징을 활용하여 "익음"과 "덜 익음"처럼 시각적으로 미묘한 차이를 구분하는 개방형 어휘 탐지(open-vocabulary detection)를 가능하게 한다. 그 결과, 시각 정보에만 의존하던 기존 모델들의 한계를 극복하고 더 높은 수준의 의미론적 분별력을 달성했다(Zhu et al., 2025). 다만, 순수 Transformer 모델은 여전히 높은 계산 비용을 요구하기에, CNN의 효율성과 Transformer의 전역적 분석 능력을 결합한 하이브리드(hybrid) 구조가 실용적인 대안으로 활발히 연구되고 있다. 예를 들어, Litchi-YOLO 모델에 적용된 HyCTAS 모듈은 경량 컨볼루션과 메모리 효율적인 Self-Attention 메커니즘을 결합하여, 파라미터 증가를 최소화하면서도 지역적 특징과 전역적 맥락을 동시에 포착했다(Wang et al., 2025a). 이처럼 Transformer 기술은 독립적인 탐지 모델로서뿐만 아니라, 기존 CNN 아키텍처의 표현력을 강화하는 모듈로 통합되거나, 깊이 추정(DPT, DINOv2)과 같은 3차원 인식 과업으로까지 그 영향력을 확장하고 있다.

3D Perception & 6D Pose Estimation

단순한 2차원 경계 상자 정보는 객체의 존재와 대략적인 위치를 표현하는 데 유용한 기초 정보를 제공한다. 그러나 로봇 그리퍼(gripper)가 목표물과 물리적으로 상호작용하는 고도화된 농업 자동화 시스템에서는 보다 정밀한 공간적 맥락이 요구된다(Hwang et al., 2024). 접근(approach), 파지(grasping), 그리고 조작(manipulation) 과정에서 최적의 성능을 달성하기 위해서는 작물의 정확한 3차원 공간 좌표(x, y, z), 물리적 크기, 그리고 6자유도(6-DoF) 방향 정보를 포함하는 고차원적 공간 인식이 중요하다(Jang and Hwang, 2024; Ni et al., 2024). 이러한 기술의 정밀도는 수확 성공률, 단위 시간당 작업량, 그리고 수확물의 손상률과 같은 시스템의 전체 성능 지표를 향상시키는 핵심 요소로 작용하며, 이에 따라 3D 센서 데이터를 활용한 정밀한 3차원 인식 기술이 현대 정밀 농업 및 수확 로봇 시스템의 중요한 구성 요소로 자리잡고 있다(Liu et al., 2024b).

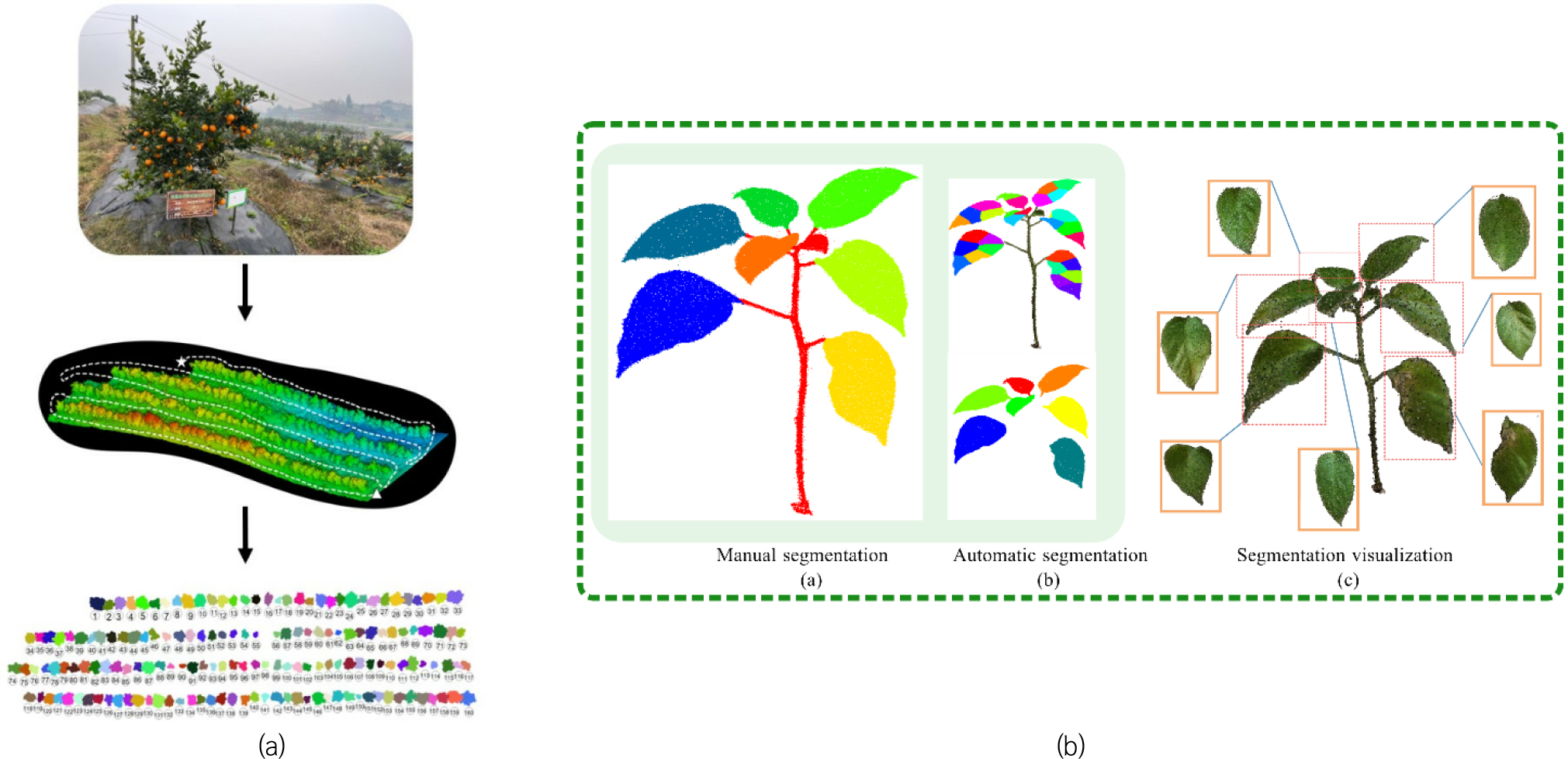

Point Cloud Pre-processing and Segmentation

RGB-D 센서로부터 획득된 원시(raw) 포인트 클라우드 데이터는 목표 객체뿐만 아니라 배경, 지지 구조물, 그리고 센서 자체의 측정 노이즈 등 불필요한 정보를 다량 포함하고 있다. 따라서 신뢰도 높은 3차원 분석을 위해서는 체계적인 전처리 및 분할 과정이 선행되어야 한다(Xie et al., 2024). 첫 단계는 먼저 데이터의 품질을 저해하는 이상치(outlier)를 제거한다. 각 포인트의 국소적 밀도를 분석하여 기준치 이하의 포인트를 제거하는 통계적 이상치 제거(Statistical Outlier Removal)나, 특정 반경 내 이웃 포인트 수를 기준으로 필터링하는 반경 이상치 제거(Radius Outlier Removal)와 같은 알고리즘이 널리 적용되며, 이는 센서의 측정 한계나 반사 특성으로 인해 발생하는 희소하고 무작위적인 노이즈를 효과적으로 억제할 수 있다(Karim et al., 2025; Li et al., 2024a). 이후, 개별 과일이나 줄기 등의 객체를 분리하기 위한 분할(segmentation)이 진행된다. 온실의 선반이나 선별 라인의 컨베이어 벨트와 같이 명확한 평면 구조가 존재하는 경우, RANSAC(Random Sample Consensus) 알고리즘을 이용하여 지배적인 평면 모델을 추정하고 해당 포인트를 배경으로 간주하여 제거하는 방식이 있다(Huang et al., 2025b). 배경이 제거된 포인트 클라우드에서 개별 객체를 분리하기 위해, 포인트 간의 유클리드 거리를 기반으로 군집을 형성하는 유클리드 군집화(Euclidean Clustering)나 밀도 기반의 DBSCAN (Density-Based Spatial Clustering of Applications with Noise) 알고리즘이 전통적으로 사용되어 왔다(Fig. 3)(Zhang et al., 2024b). 그러나 과일, 잎, 줄기가 복잡하게 얽혀 있는 비정형 환경에서는 순수 3D 기하 정보만으로 객체를 분리하는 데 한계가 존재한다(Zhou et al., 2025c). 이러한 문제를 해결하기 위해, 최근 연구들은 2D 이미지에서 딥러닝 기반 인스턴스 분할(instance segmentation) 모델을 통해 얻은 픽셀 단위 마스크(pixel-wise mask)를 3D 공간으로 역투영(back-projection)하는 하이브리드 접근법이 연구되고 있다(van Marrewijk et al., 2025; Wang and Zhang, 2025). 이 방식은 2D 이미지의 풍부한 색상 및 텍스처 정보를 활용하여 3D 공간에서의 분할 정확도를 크게 향상시키는, 비용 대비 효율적인 전략으로 평가받고 있다.

Fig. 3.

Point-cloud preprocessing and segmentation pipeline. (a) fast Euclidean clustering(Li et al., 2024a), (b) Leaf instance segmentation using clustering(Zhu et al., 2024b).

Point Cloud Pre-processing and Segmentation

정확하게 분할된 개별 객체의 포인트 클라우드는 작물의 다양한 물리적 속성을 정량적으로 추정하는 기반이 될 수 있다. 이러한 정보는 작물의 성숙도 판단, 수확량 예측, 그리고 로봇의 파지 전략 수립에 직접적으로 활용된다. 가장 직관적인 접근법은 3D 가 아닌 2D 이미지의 픽셀 단위 측정값을 깊이 정보와 초점 거리 등의 카메라 내부 파라미터(intrinsic parameters)를 결합하여 실제 물리 단위로 변환하는 것이다. 예를 들어, 분할된 객체의 2D 마스크 내 픽셀 수를 계산하고, 해당 픽셀들의 평균 깊이 값을 이용해 객체의 표면적이나 부피를 근사적으로 추정할 수 있다(Zheng et al., 2025; Zhu et al., 2025). Igathinathane 등은 2D 이미지를 기반으로 농산물 길이에 따라 여러 지점의 너비를 측정하는 ‘다중 너비 측정(multiple width measurement)’을 사용했으나, 이와 동시에 2D 이미지 기반 측정 방식이 가진 현실적인 한계점들을 지적했다. 구체적으로, 농산물의 꼭지 방향이 일정하지 않을 경우, 객체들이 서로 접촉하거나 겹칠 때 개별 인식이 어려운 문제 등을 언급하며, 이는 2D 이미지 분석이 가진 근본적인 한계임을 보여주었다(Igathinathane et al., 2025). 반면 3D 포인트 클라우드에서는 보다 직접적인 기하학적 측정이 가능하다. 객체를 구성하는 포인트들의 3차원 분포를 분석하여 최장 및 최단 거리, 바운딩 박스의 크기 등을 계산할 수 있으며 객체의 형상이 구(sphere)나 원통(cylinder)에 가깝다고 가정할 수 있는 경우, 최소자승법(Least Squares Method) 또는 RANSAC을 이용해 해당 기하 모델을 포인트 클라우드에 피팅(fitting)함으로써 직경, 길이, 중심점 등의 파라미터를 안정적으로 추정하는 것이 가능하다(Zhu et al., 2025). 이러한 측정값은 작물의 성숙도 판단 및 수확량 예측에 중요한 데이터로 활용된다.

6D Pose Estimation

6D Pose Estimation은 3D 위치(x, y, z)와 3D 방향(roll, pitch, yaw)을 포함하는 6자유도 자세를 추정하는 방식이다. 로봇의 엔드 이펙터(end-effector)가 작물을 손상시키지 않고 정확한 지점을 파지하거나 절단하기 위해서는, 객체의 3차원 위치뿐만 아니라 3차원 방향을 포함하는 6자유도 자세 정보가 필수적이다. 특히 줄기를 잘라야 하는 작물의 경우, 절단점의 위치와 줄기의 방향 벡터를 정밀하게 파악하는 것이 관건이다(Zhang et al., 2024c).

이러한 자세를 추정하기 위한 접근법 중 키포인트(Keypoint) 기반 추정 방식은 과일의 꼭지, 줄기 연결점, 분기점 등 해부학적으로 의미 있는 주요 지점들을 2D 이미지에서 먼저 탐지한다. 이후 각 키포인트에 해당하는 3D 좌표를 깊이 맵에서 추출하고, 이 3D 키포인트들 간의 상대적인 기하학적 관계를 분석하여 객체의 전체적인 자세를 재구성한다. 이 방법은 객체의 일부가 가려진 상황에서도 비교적 강건하며, 직관적인 라벨링이 가능하다는 장점이 있다(Dai et al., 2025b; Fang et al., 2025; Hou et al., 2025). Dai등은 딸기의 공간적 특성을 고려하여 꼭지(P1)와 수확 지점(P2)을 두 개의 키포인트로 선택, 이 두 점을 잇는 벡터를 계산하여 줄기의 방향을 추정하였다(Dai et al., 2025b). 다른 접근법으로는 단일 RGB 또는 RGB-D 이미지로부터 객체의 6D 자세를 직접 예측하도록 EfficientPose와 같은 딥러닝 모델을 학습시키는 엔드투엔드(End-to-end) 회귀 방식이 있다(Sorour and From, 2025; Zhao et al., 2025). 이러한 모델들은 실제 환경에서 대규모의 정답 데이터를 수집하기 어려운 문제를 해결하기 위해, 종종 시뮬레이션 환경에서 생성된 합성 데이터셋(synthetic dataset)을 학습에 활용하기도 한다.

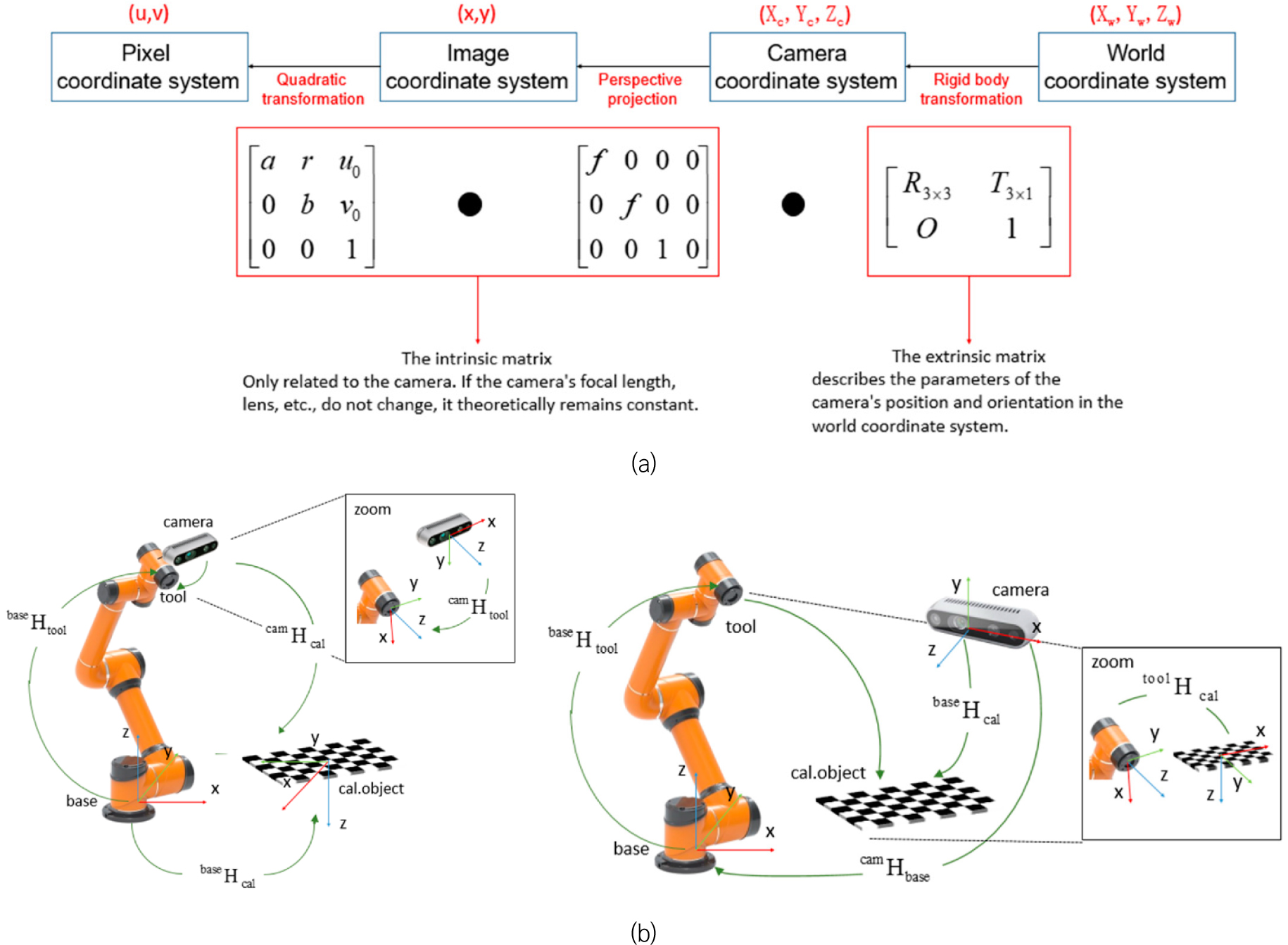

이렇게 카메라 좌표계에서 계산된 작물의 3D 위치 및 자세 정보는 로봇이 이해하고 실행할 수 있는 로봇 베이스 좌표계(robot base coordinate system)로 변환되어야 한다. 이 변환 과정은 사전에 정밀하게 측정된 Hand-Eye Calibration을 통해 얻어진 변환 행렬(transformation matrix)을 통해 이루어진다. 최종적으로 변환된 좌표는 로봇 팔의 경로 계획(path planning) 알고리즘에 입력되어, 작업 공간 내의 장애물과 충돌을 회피하며 목표물에 도달하는 최적의 궤적을 생성하고 엔드 이펙터의 정밀한 움직임을 제어하는 데 사용된다(Fig. 4)(Wang et al., 2025a; Xin Wang et al., 2025d).

이러한 3D 인식 및 자세 추정 기술은 다양한 센서 기술과 정교한 데이터 처리 알고리즘의 결합을 통해 농업 로봇의 눈과 뇌 역할을 수행한다. 이를 통해 로봇은 복잡하고 비정형적인 농업 환경에서도 인간 작업자와 유사한 수준의 정밀한 인지 및 조작 능력을 갖출 수 있게 되며, 이는 완전 자동화된 수확 시스템 구현의 핵심 기반 기술이라고 할 수 있다.

Fig. 4.

Hand-Eye Calibration: Configurations and Coordinate Transformation (Zhang et al., 2024a). (a) The transformation from the camera coordinate system to the robot base coordinate system. (b) Camera mounting configurations: (b-1) Eye-in-Hand, where the camera is on the robot’s end-effector, and (b-2) Eye-to-Hand, where the camera is fixed.

Quality, Grade, and Maturity Estimation

작물의 등급, 품질 및 성숙도를 정확하게 추정하는 것은 수확 후 관리의 효율성을 높이고, 상품의 시장 가치를 결정하며, 최종적으로 소비자 만족도를 향상시키기 위한 핵심적인 과정이다(Hu et al., 2025; You et al., 2025a). 전통적인 수동 평가는 작업자의 주관과 피로도에 따라 결과의 일관성이 떨어지는 반면, 컴퓨터 비전, 분광학, 딥러닝과 같은 첨단 기술을 활용한 자동화 시스템은 객관적이고 신속하며 일관된 결과를 제공하는 대안으로 부상하고 있다(Kalaiselvi, 2025; Hu et al., 2025; Kanwal et al., 2025). 이러한 기술들은 작물의 외관 특성(색상, 크기, 모양, 결함)뿐만 아니라, 육안으로 식별 불가능한 내부 품질(당도, 산도, 경도)까지 비파괴적으로 측정하여 종합적인 품질 평가를 가능하게 한다. 관련 주요 연구 사례는 Table 4와 같다.

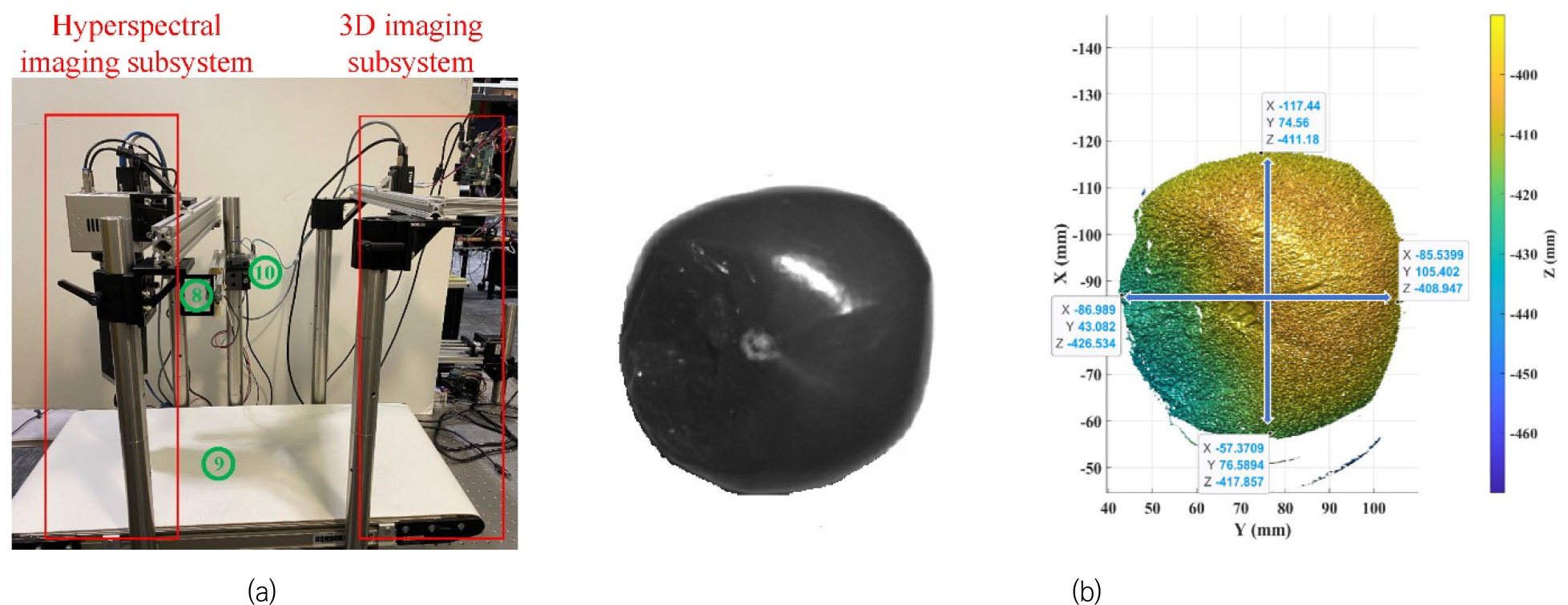

Appearance-based Quality Assessment using Visual Features

자동화된 품질 평가에서 가장 직관적이고 널리 사용되는 접근법은 인간의 시각과 유사하게 작물의 외관에서 드러나는 다양한 특징을 디지털 이미지로 분석하는 것이다. 이러한 외관 품질은 상품의 등급을 결정하고 소비자의 초기 구매 결정을 유도하는 핵심적인 요소로 작용한다. 주요 분석 대상은 색상, 형태, 그리고 표면 결함으로 나눌 수 있다. 작물의 색상은 성숙도와 가장 밀접한 상관관계를 가지는 지표 중 하나로, 딥러닝 모델, 특히 CNN은 전통적인 RGB 색 공간뿐만 아니라 상대적으로 조명 변화의 영향을 덜 받는 HSV나 CIELab과 같은 다양한 색 공간의 특징을 복합적으로 학습하여 성숙 단계를 정밀하게 분류하는 데 활용된다(Hao et al., 2025; Wang et al., 2025a). 크기와 모양은 상품의 균일성과 시장 표준을 결정하는 중요한 등급 분류 기준으로, 컴퓨터 비전 시스템은 2D 혹은 3D 이미지에서 객체의 윤곽선을 정밀하게 추출하여 장축, 단축, 면적, 원형도, 종횡비 등 다양한 기하학적 특징을 계산한다(Mei et al., 2025). 예를 들어 구조광(Structured-light) 스캐닝 기술을 활용하면 Fig. 5와 같이 객체의 정밀한 3D 모델을 복원하여 직경이나 부피와 같은 정량적 수치를 얻을 수 있다. 이러한 정량적 지표는 특정 기준에 따라 등급을 분류하는 데 사용될 수 있는데, 예를 들어 망고 등급 분류 시스템에서는 크기와 모양 특징을 주요 변수로 사용하여 9개의 상업적 등급으로 자동 분류하는 연구가 수행되었다(Kalaiselvi, 2025). 또한, 딸기의 기형 여부를 판단하는 연구에서는 변형 지점의 수, 변형률, 공간 거리와 같은 복합적인 지표를 사용하여 정상과 기형을 효과적으로 구분했다(Jiang et al., 2025). 마지막으로 흠집, 멍, 병해, 갈라짐 등 표면의 결함은 상품의 가치를 현저히 저하시키는 요인이다(Zhou et al., 2025a). YOLO, Faster R-CNN, Mask R-CNN과 같은 객체 탐지 및 인스턴스 분할 모델은 다양한 유형의 결함을 높은 정확도로 식별하고 그 면적을 정량화하는 데 매우 효과적이다. 사과의 미세한 멍을 탐지하거나 오렌지의 네 가지 주요 질병을 구분하는 연구들이 이를 입증했으며, 망고 품질 검사에서는 결함 부위의 면적을 정량화하여 최종 품질 등급을 결정하는 데 활용되었다(Hu et al., 2025).

Fig. 5.

Geometric Feature Extraction from a 3D Reconstructed Model(Naqvi et al., 2025). (a) Raw data acquisition, (b) Reconstructed 3D mesh for geometric feature extraction.

Internal Quality Estimation using Non-destructive Sensors

소비자가 최종적으로 인지하는 식품의 품질은 눈에 보이는 외관을 넘어, 당도, 산도, 경도와 같은 내부 속성에 의해 결정적으로 좌우된다(Yan et al., 2025b). 이러한 내부 품질을 파괴적인 방법 없이 실시간으로 측정하기 위해, 다양한 물리적 원리에 기반한 비파괴 센서 기술들이 활발히 연구되고 있다. 그중에서도 가시광선/근적외선(Visible light/Near-Infrared) 분광 기술은 가장 대표적인 방법으로, 빛과 물질 간의 고유한 상호작용을 분석하여 화학적 성분을 예측한다[66,79,80]. 광원이 과일 내부에 침투했다가 반사되거나 투과된 스펙트럼 데이터에는 당(C-H 결합), 수분(O-H 결합) 등 특정 유기 분자의 진동과 관련된 고유한 흡수 및 반사 정보가 포함되어 있다(Fu et al., 2025; Wang et al., 2025g). 또한 수집된 스펙트럼 데이터에 PLSR, SVM, ANN과 같은 전통적인 머신러닝 알고리즘이나 최신 딥러닝 모델을 적용하여 가용성 고형물 함량(SSC), 산도, 수분 함량 등을 예측하는 모델을 구축할 수 있다. 사과의 SSC 예측 연구에서는 스펙트럼 형태 특징을 CNN 모델과 결합하여 결정계수 0.976의 매우 높은 예측 정확도를 달성했으며, 복숭아의 SSC, 경도, 수분 함량을 동시에 예측하는 연구도 수행되었다(Wang et al., 2025b; Yan et al., 2025b).

또한, 단일 센서의 한계를 극복하고 예측 정확도를 높이기 위해 여러 종류의 센서 데이터를 융합하는 다중 센서 융합(Multi-sensor Fusion) 연구가 활발히 진행되고 있다. 열화상 데이터와 Vis/NIR 스펙트럼을 결합하여 망고의 냉해와 타박상을 동시에 탐지하는 연구, 초음파, 감마선, 저자장 핵자기공명(LF-NMR) 등 다양한 물리적 측정 기술을 HSI와 융합하여 블루베리의 내부 부패를 탐지하는 연구등이 진행되었다(He et al., 2025a; Yuan et al., 2025). 또한 RGB 이미지의 시각적 특징과 스펙트럼 데이터를 결합하여 체리 토마토의 라이코펜 함량을 예측하는 모델은 원시 스펙트럼-이미지 융합을 통해 예측 성능(결정계수0.95)을 극대화한 연구이다(Zheng et al., 2025).

한편, 과육의 단단함과 같은 물리적 특성은 숙성도와 직결되는 중요한 지표이다(Liu et al., 2025d). 이를 측정하기 위해 로봇 그리퍼에 내장된 유연한 압력 센서나 택타일(tactile) 센서는 과일을 파지할 때 발생하는 압력과 변형 데이터를 시계열 형태로 수집하며(Ait Ameur et al., 2025; Liu et al., 2025d), 이 데이터를 LSTM과 같은 순환 신경망 모델로 분석하여 토마토의 숙성도를 99%의 정확도로 분류한 연구 사례가 있다. 더 나아가, 공기 분사로 사과에 미세한 진동을 가하고 그 반응을 레이저 도플러 진동계(Laser Doppler Vibrometer)로 측정하여, 외관상으로는 식별이 불가능한 내부의 곰팡이를 탐지하는 연구도 수행되었다(Zhai et al., 2025). 이러한 비전 기반 기술의 보완적 수단들은 색상 변화가 뚜렷하지 않은 과일의 숙성도를 판단하거나 내부 결함을 감지하는 데 특히 유용한 접근법을 제공한다.

Ground Truth for Non-destructive Estimation Models

앞서 언급된 다양한 비파괴 품질 추정 모델들을 개발하고 그 성능을 객관적으로 검증하기 위해서는, 신뢰할 수 있는 참조 표준(ground truth) 데이터의 확보가 무엇보다 중요하다. 이러한 데이터는 전통적인 실험실 분석법을 통해 얻어지며, 비파괴 센서 데이터와 연계되어 머신러닝 및 딥러닝 모델을 학습시키고 평가하는 데 있어 가장 중요한 기준점으로 작용한다. 내부 품질 지표의 경우, 가용성 고형물 함량(Soluble Solids Content, SSC)은 디지털 굴절계(refractometer)를 이용해 브릭스(°Brix) 단위로 측정하며 과즙 내 용해된 당과 기타 고형물 농도에 따라 빛의 굴절률이 달라지는 원리를 이용한다(Qiao et al., 2025; Zhou et al., 2025b). 적정산도(Titratable Acidity, TA)는 과일의 신맛을 결정하는 유기산 함량을 측정하는 방법으로 수산화나트륨(NaOH) 용액을 이용한 적정법(titration)으로 정량화한다. 일정량의 과즙을 채취한 뒤, 농도를 알고 있는 알칼리 표준 용액(수산화나트륨, NaOH)을 떨어뜨려 중화점(일반적으로 pH 8.2)에 도달할 때까지 소모된 양을 측정한다. 이를 통해 시트르산, 말산 등 주요 유기산의 총량으로 환산한다(Dai et al., 2025a). 과육의 경도는 특정 직경의 프로브를 일정한 속도로 과육에 관통시키면서 발생하는 저항력(N)을 측정하는 물성 분석기(texture analyzer)로 측정하고(Yang et al., 2025b), 수분 함량은 시료의 초기 무게를 측정한 후, 100~105°C의 건조기에서 항량이 될 때까지 건조시켜 수분을 완전히 제거, 건조 후 무게를 측정하여 그 차이를 계산하는 상압가열건조법을 사용한다(Yang et al., 2025b). 라이코펜, 안토시아닌과 같은 특정 기능성 성분은 성분 분리 분석법(High-Performance Liquid Chromatography, HPLC)나 분광광도계(spectrophotometer)를 사용하여 정밀하게 분석한다(Zheng et al., 2025). 외부 품질 지표의 경우, 크기와 형상은 디지털 캘리퍼스(digital calipers)를 사용하여 과일의 장축과 단축을 직접 측정하여 확보하며(Igathinathane et al., 2025; Liu et al., 2025b; Xu and Lu, 2024), 내부 결함의 정도와 부피는 과일을 절단하여 단면을 직접 관찰하거나 촬영하여 정량화 한다. 이처럼 정밀한 파괴적 분석을 통해 얻어진 측정값들은 비파괴 기술의 정확도를 보증하는 근거가 될 수 있다.

Table 4.

Summary of effective spectral wavelengths for crop quality evaluation.

| Crop | Quality trait | Effective wavelengths (nm) | Reference |

| Tomato | SSC | 680-720 | Cai et al. (2024a) |

| 900-1000 | Huang et al. (2025a) | ||

| pH | 649, 805, 1071, 1929 | Tasioulas et al. (2025) | |

| Strawberry | SSC | 550-680 | Seki et al. (2024) |

| Anthocyanins | 500-535 | ||

| Citrus | SSC | 960-990 | Kim et al. (2024) |

| chlorophyll | 680 | ||

| Melon | SSC |

670-720 900-1100 | Kasampalis et al. (2025) |

| TA |

1050-1150 1350-1450 | ||

| Dry matter |

900-1000 1900-1950 |

Model Lightweighting and Optimization

앞선 절들에서 논의된 다양한 컴퓨터 비전 알고리즘들이 높은 수준의 정확도와 강건성을 달성하였음에도 불구하고, 이들의 실용적 가치는 실제 농업 현장의 물리적 제약 조건 속에서 얼마나 효율적으로 구동될 수 있는지에 따라 최종적으로 결정된다. 현대의 심층 신경망 모델들은 수백만 개 이상의 파라미터와 높은 계산 복잡도를 특징으로 하며, 이는 충분한 연산 능력과 전력을 갖춘 서버 환경에서는 문제가 되지 않는다. 그러나 수확 로봇, 자율주행 드론, 또는 분산형 IoT 센서와 같은 엣지 컴퓨팅(Edge Computing) 환경은 제한된 연산 능력, 부족한 메모리 용량, 그리고 저전력 소비를 요하는 본질적인 제약을 가지고 있다(B. Yan et al., 2025). 예를 들어, 대규모 모델은 추론 과정에서 상당한 지연 시간(latency)을 유발하여 실시간 반응이 필수적인 수확 로봇과 같은 동적 시스템에는 부적합할 수 있다. 이러한 배경에서, 모델의 예측 정확도와 추론 효율성 사이에는 필연적인 상충 관계(Trade-off)가 발생한다(Krklješ et al., 2025). 즉, 모델의 크기와 계산량을 줄이는 경량화 과정은 추론 속도를 향상시키는 반면 정확도의 손실을 야기할 수 있으며, 반대로 정확도를 극대화하는 것은 모델의 복잡도를 증가시켜 현장 배포를 어렵게 만든다. 따라서 각 농업 응용 분야의 실시간 요구사항과 하드웨어 제약을 만족시키면서도, 허용 가능한 범위 내에서 최고의 정확도를 확보하는 최적의 균형점을 찾는 것이 모델 경량화 및 최적화 연구의 핵심 목표라 할 수 있다(He et al., 2025b; Tong, 2025).

Proactive Lightweighting based on Efficient Architecture Design

모델 경량화를 위한 가장 근본적인 접근법은 네트워크 아키텍처 설계 단계에서부터 연산 효율성을 극대화할 수 있는 선행적 경량화이다. 이는 대규모 모델을 사후에 압축하는 방식과 달리, 적은 파라미터와 계산량(Floating Point Operations Per Second, FLOPs)으로도 높은 수준의 특징 표현력을 유지하도록 최적화된 구조에 초점을 맞춘다. 이러한 접근법의 핵심은 심층 신경망의 가장 기본적인 연산 단위인 합성곱 연산을 재구성하는 데 있다. 깊이별 분리 합성곱(Depthwise Separable Convolution, DSC/DWConv)은 표준 합성곱 연산을 공간적 특징 추출(Depthwise Convolution)과 채널 간 정보 결합(Pointwise Convolution)의 두 단계로 분해하여, 파라미터 수와 계산량을 극적으로 감소시키는 대표적인 기법이다(B. Yan et al., 2025). 이는 MobileNet과 같은 다수의 경량 네트워크에서 핵심 구성 요소로 채택되었으며, YOLO-TMPPD 모델에서는 DWConv를 도입하여 파라미터 수를 줄이고 계산 효율성을 높였다(Xinfa Wang et al., 2025e). 또한, YOLOv10n-CGD 모델에서는 gConv Block 내에 DWConv를 통합하여 계산 부담을 크게 완화하는 방식으로 활용되었다(Yuan et al., 2025).

이와 더불어, 입력 채널의 일부에만 필터를 적용하여 계산 중복성을 원천적으로 제거하는 부분 합성곱(Partial Convolution, PConv)은 FasterNet 아키텍처의 핵심 요소로 제안되었다. AOD-Net 모델은 PConv의 원리를 적용한 CSPC 구조를 통해 연산량을 효과적으로 줄였으며(Tong, 2025), MFD-YOLO 모델은 E-ELAN 모듈에 PConv를 통합하여 특징 융합 효율을 개선하고 파라미터를 감소시키는 성과를 보였다(Yang et al., 2025a). 또한, 적은 수의 필터로 핵심 특징 맵을 생성한 뒤 간단한 선형 변환을 통해 나머지 특징 맵을 추론하는 고스트 합성곱(Ghost Convolution, GhostConv)은 GhostNet의 핵심 아이디어로(You et al., 2025b), 여러 경량화 연구에서 채택되고 있다. 이러한 효율적인 연산들을 기반으로 설계된 MobileNet, ShuffleNet, GhostNet, FasterNet과 같은 대표적인 경량 네트워크 아키텍처들은 농업 분야의 다양한 AI 모델에서 백본(backbone)으로 활발히 활용되고 있다(Liu et al., 2025e). Bu등은 ShuffleNet V2를 기반으로 모델을 개선하여 경량성과 고속 성능을 확보했으며(Bu et al., 2025), Liu등은 FasterNet을 백본으로 채택하여 복잡한 배경 속에서도 강건한 특징 추출 능력을 입증했다(Liu et al., 2025a).

Post-hoc Optimization through Model Compression and Acceleration Techniques

이미 학습된 고성능의 대규모 모델을 실제 배포 환경에 맞게 효과적으로 압축하고 가속하는 후행적 최적화 기법들 또한 활발히 연구되고 있다. 이러한 기법들은 기존 모델의 지식을 최대한 보존하면서 배포 환경에 최적화된 형태로 변환할 수 있다는 장점을 가진다.

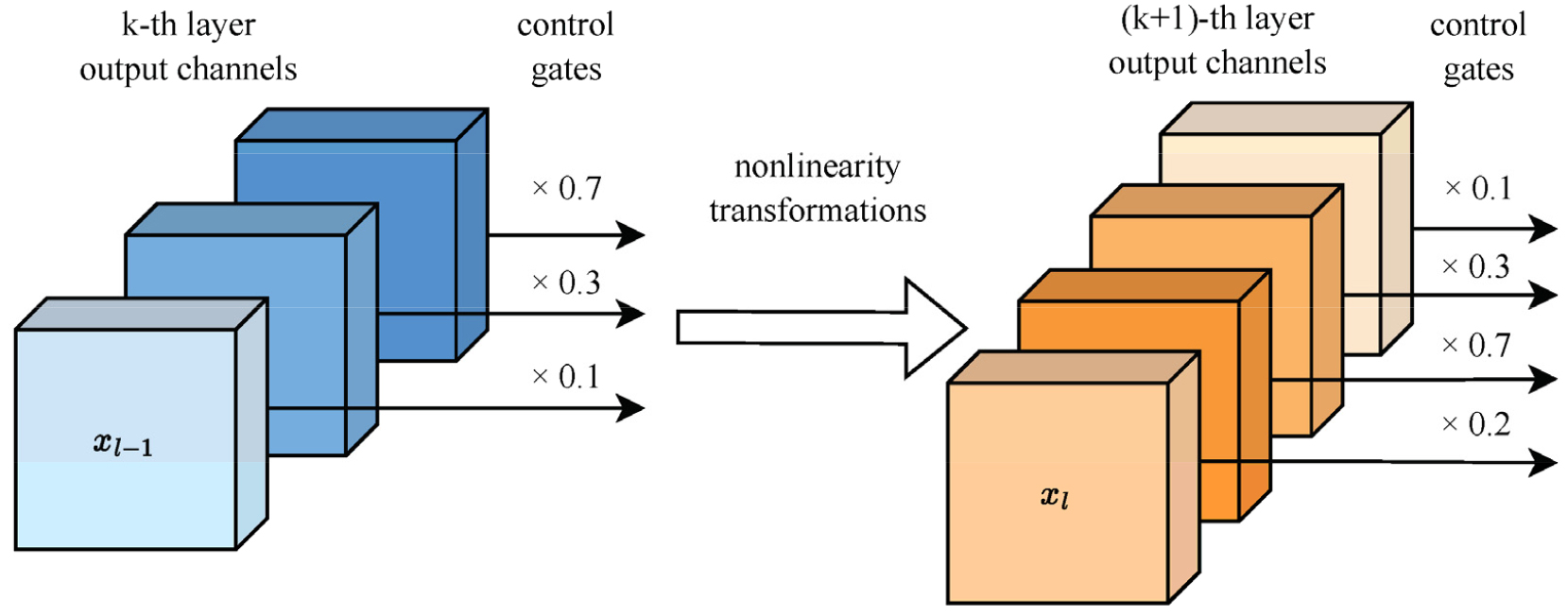

첫 번째, 가지치기(Pruning)는 모델의 예측 성능에 미미한 영향을 미치는 불필요한 가중치, 뉴런, 또는 채널을 체계적으로 제거하여 모델을 압축하는 기술이다. 이 과정은 각 채널의 중요도를 스케일링 인자(scaling factor)나 제어 게이트(control gate) 등으로 평가하고, 기여도가 낮은 채널을 제거하는 방식으로 이루어진다(Fig. 6). 예를 들어, LAMP(Layer-adaptive sparsity for Magnitude- based Pruning) 는 각 레이어의 중요도를 고려하여 서로 다른 가지치기 비율을 적응적으로 설정하는 방식으로, 딸기 수확 로봇을 위한 모델 경량화에 적용되어 중복 파라미터를 효과적으로 제거했다(Dai et al., 2025b; Liu et al., 2025e). 또한, Slimming 알고리즘은 채널의 중요도를 나타내는 스케일링 인자를 활용하여 중요하지 않은 채널 전체를 제거하는 구조적 가지치기 기법으로, YOLOv8-MDN-Tiny 모델 압축에 성공적으로 사용되었다(Chen et al., 2025c).

두 번째, 지식 증류(Knowledge Distillation)는 크고 복잡한 ‘교사 모델(teacher model)’이 학습한 일반화된 지식을 작고 가벼운 ‘학생 모델(student model)’에 효과적으로 전달하는 학습 방식이다. 이를 통해 학생 모델은 작은 크기에도 불구하고 교사 모델에 준하는 높은 성능을 달성할 수 있다. Yang등이 제안한 AWKD(Adaptive Weighted Knowledge Distillation)는 성능이 우수한 YOLOv7을 교사 모델로, 경량화된 MFD-YOLO를 학생 모델로 설정하고, 분류 손실과 평균 제곱 오차 손실을 적응형 가중치로 결합하여 지식을 효과적으로 전달했다(Yang et al., 2025a). 또한, CWD(Channel-Wise Knowledge Distillation)는 채널 차원에서 교사와 학생 네트워크 간의 출력 분포 차이를 최소화하는 방식으로 지식을 증류하며, YOLOv8-MDN-Tiny 모델의 가지치기 후 발생할 수 있는 성능 손실을 복구하는 데 기여했다(Chen et al., 2025c).

세 번째, 양자화(Quantization)는 모델의 가중치와 활성화 함수 값을 32비트 부동소수점(FP32)에서 16비트(FP16) 또는 8비트 정수(INT8)와 같은 낮은 정밀도로 변환하는 기술이다. 이러한 정밀도 감소는 모델 크기를 획기적으로 줄이고 메모리 대역폭 요구사항을 완화하며, 특히 정수 연산을 지원하는 하드웨어에서 추론 속도를 크게 향상시킬 수 있다. Gan등은 NVIDIA Jetson AGX Orin에 배포하는 과정에서 FP16 양자화를 적용하여, 성능 저하를 최소화하면서도 효율적인 실시간 탐지를 가능하게 했다(Gan et al., 2025; Yuan et al., 2025).

Hardware Deployment, Inference Optimization,

모델 경량화와 최적화가 완료되면, 최종적으로 실제 농업 현장의 엣지 디바이스에 모델을 배포하여 추론 성능을 극대화하고 그 실용성을 검증해야 한다. 농업용 로봇 및 AI 시스템에는 주로 고성능 GPU가 탑재된 임베디드 플랫폼이 사용되며, 그중에서도 NVIDIA Jetson 시리즈(Jetson Nano, Jetson AGX Orin)는 GPU 가속을 통한 AI 모델의 실시간 추론을 지원하여 농업 분야에서 널리 사용되는 대표적인 엣지 컴퓨팅 플랫폼으로 자리 잡았다. YOLOv10n-CGD 모델은 Jetson AGX Orin에서 44.9 FPS의 탐지 속도를 달성했으며, SR-YOLO 모델 역시 동일한 플랫폼에 배포되어 90.1 FPS라는 높은 실시간 탐지 속도를 보였다(Yuan et al., 2025). 최근에는 OrangePi5pro와 같은 저비용 싱글 보드 컴퓨터(SBC) 또한 NPU(신경망 처리 장치) 가속을 통해 실시간 추론을 지원하며 토마토 크기 측정 시스템에 성공적으로 배포된 바 있다(Deng et al., 2025; You et al., 2025b).

최적화된 모델을 하드웨어에서 최대한의 성능으로 실행하기 위해서는 NVIDIA TensorRT와 같은 추론 엔진의 역할이 중요하다(B. Yan et al., 2025). TensorRT는 학습된 모델을 특정 NVIDIA GPU 아키텍처에 맞게 최적화하여 추론 성능을 극대화하는 소프트웨어 라이브러리로, 연산자 퓨전(Operator Fusion), 레이어 통합, 그리고 정밀도 보정(FP16/INT8 양자화)과 같은 다양한 기법을 통해 신경망의 추론 지연 시간을 줄이고 처리량을 높인다.

최종적으로 모델의 실용성을 평가하기 위해서는 정확도뿐만 아니라 다양한 효율성 지표를 종합적으로 고려하는 다차원적 성능 검증이 필수적이다. 초당 처리 프레임 수를 나타내는 FPS(Frames Per Second), 단일 이미지 처리 시간을 의미하는 Latency(ms), 디바이스 저장 공간과 관련된 Model Size(MB), 모델의 복잡도를 나타내는 파라미터 수와 계산량 등을 종합적으로 분석하여 각 농업 응용 분야에 맞는 최적의 균형점(Sweet Spot)을 찾아야 한다(Liang et al., 2025; You et al., 2025a). 예를 들어, Yang등은 MFD-YOLO 모델은 mAP@.5 97.5%, 128 FPS, 모델 크기 3.58MB를 달성하여 정확도, 속도, 경량성 사이의 뛰어난 균형을 보여주었다(Yang et al., 2025a). 이는 자원이 제한된 환경에서도 실시간으로 정확한 탐지를 가능하게 하여, 지능형 농업 시스템의 실용성을 높이는 핵심 기술임을 입증하는 사례라 할 수 있다.

Key Limitations and Future Research Directions

Key Limitations of Current Research

Data Scarcity and Lack of Standardization

기술들의 발전에도 불구하고, 그 성능과 일반화 능력의 근간이 되는 데이터의 문제는 여전히 농업 컴퓨터 비전 분야의 발전을 저해하는 가장 근본적인 제약으로 작용한다. 현재 발표되는 대다수의 연구는 특정 품종, 단일 농장, 제한된 재배 시기 및 환경 조건에서 수집된 자체 데이터셋(self-collected dataset)에 의존하여 모델을 개발하고 검증하는 경향이 짙다. 예를 들어, Yuan등은 특정 지역과 기간에 수집된 데이터의 한계로 인해 계절의 변화, 과수원의 다양한 조건, 그리고 품종의 다양성을 충분히 반영하지 못했음을 한계점으로 명시했다(Yuan et al., 2025). 마찬가지로, You등은 실제 과수원 환경에서 수집한 데이터와 웹 스크래핑을 통해 데이터를 보강했음에도 불구하고, 주로 특정 품종(Northern Highbush)에 초점을 맞추고 있어 다른 품종에 대한 일반화 성능은 미지수이다(You et al., 2025a). 이러한 개별 연구 중심의 데이터셋 구축은 다양한 환경과 품종, 예측 불가능한 병해충 및 생리장애를 포괄하는 대규모 공개 벤치마크 데이터셋의 부재라는 구조적 문제로 귀결된다. 표준화된 벤치마크가 없기 때문에 연구 결과 간의 공정하고 객관적인 성능 비교가 어려우며, 이는 모델의 실제 현장 적용성과 일반화 성능을 신뢰하기 어렵게 만드는 주요 요인이다.

Lack of Robustness to Extreme Environmental Changes

통제된 실험실 환경을 벗어나 실제 농업 현장에 배치되는 수확 로봇은 예측 불가능한 악조건에 대한 강건성(robustness)이라는 한계에 직면한다. 실제 필드는 변화무쌍한 자연 조명 조건, 농작업 중 발생하는 환경적 먼지, 비나 안개와 같은 극한의 기상 변화, 그리고 고르지 않은 지형과 같이 알고리즘의 성능을 저하시키는 요인이 다수 존재한다. 특히, Liang등은 안개가 끼거나 어두운 저조도 환경과 같은 악조건에 대한 모델의 적응성 개선을 향후 핵심 과제로 제시하였다(Liang et al., 2025). Yuan등 또한 강한 역광이나 어두운 조명과 같은 복잡한 과수원 환경이 탐지 정확도를 심각하게 저하시키는 주요 원인임을 언급했다(Yuan et al., 2025). Huang등은 실제 환경의 복잡한 조명 변화, 잎에 의한 빈번한 가려짐, 그리고 개체마다 상이한 불균일한 성장 패턴과 같은 문제에 효과적으로 대처하기 위해, 변화하는 환경을 스스로 학습하고 적응할 수 있는 기계 학습 알고리즘의 필요성을 강조했다(Huang et al., 2025c). 이는 단순한 이미지 변환 기술의 적용을 넘어, 실제 환경의 복잡성을 깊이 있게 이해하고 능동적으로 대응할 수 있는 차세대 강건 모델 설계의 중요성을 시사한다.

Complexity of Physical Interaction

현재의 자율 수확 시스템은 숙련된 인간 작업자가 보여주는 정교한 손재주, 상황에 맞는 적응성, 그리고 빠른 수확 속도를 완벽하게 재현하지 못한다(Conejero et al., 2025). 3차원 자세 추정을 통해 작물의 위치와 방향을 밀리미터 단위로 정확하게 파악하더라도, 무르기 쉬운 과일을 손상시키지 않고 부드럽게 잡고(grasping), 질긴 줄기를 적절한 힘으로 절단하는 것은 고도의 물리적 상호작용 기술을 요구하기 때문이다. Liu등은 토마토를 손상 없이 수확하기 위해 인간의 수확 행동에서 영감을 받은 그리퍼를 설계했지만, 파지력을 정밀하게 제어하는 기능이 없어 의도치 않은 기계적 손상을 유발할 가능성이 있음을 언급했다(Liu et al., 2025d). 이러한 문제를 해결하기 위해, 과일의 완전성을 보장하는 소프트 로보틱스(Soft Robotics) 및 실시간 힘 제어(Force Control) 기술과의 유기적인 결합이 필수적이다(Ait Ameur et al., 2025). 이에 유연한 겔(gel) 센서를 그리퍼에 내장하여 접촉력을 실시간으로 감지하고, 이를 피드백으로 활용하여 과일 손상을 방지하려는 연구들이 이루어지고 있다(Liu et al., 2025d). 또한, 실제 수확 실패 사례를 분석한 결과, 로봇 팔이 목표 과실이 아닌 토마토의 주 줄기나 과병과 충돌하여 파지에 실패하는 경우가 빈번하게 발생했다(Dai et al., 2024). 이는 단순히 목표 대상을 인식하는 것을 넘어, 주변 환경과의 복잡한 3차원 공간 관계와 물리적 상호작용을 종합적으로 고려한 정교한 조작 계획(manipulation planning)이 필요함을 명확히 보여준다.

System Integration and Economic Viability

개별 알고리즘과 하드웨어의 성능을 넘어, 이들을 하나의 안정적인 시스템으로 통합하고 경제성을 확보하는 문제는 기술의 최종적인 농가 보급을 결정짓는 가장 현실적인 장벽으로 작용한다. 농업용 로봇은 비전 센서, 고성능 컴퓨팅 유닛, 다관절 로봇 팔, 동력 시스템, 그리고 이동 플랫폼 등 다양한 이종의 구성요소들을 포함하는 고도로 통합된 시스템이다(Zhang et al., 2025a). 이러한 복합 시스템의 장기적인 안정성과 현장에서의 유지보수 편의성을 확보하는 것은 알고리즘의 정확도를 1% 향상시키는 것만큼이나, 혹은 그 이상으로 중요하다고 여겨진다. 더불어, 농업용 로봇은 비, 먼지, 진동, 그리고 넓은 온도 변화 등 매우 열악한 환경에서 안정적으로 작동해야 하므로, 모든 구성요소에 높은 수준의 내구성이 요구된다(Conejero et al., 2025). 수확 로봇의 개발 비용은 매우 높지만, 수확 작업은 특정 계절에 집중되어 연중 가동률이 낮아 투자 회수 기간(Return on Investment, ROI)이 길어질 수 있다는 경제적 딜레마가 존재한다. 향후 연구는 이러한 기술적, 공학적, 그리고 경제적 한계들을 종합적으로 극복하는 데 초점을 맞출 필요가 있다(Yuan et al., 2025).

Future Research Directions

Development and Application of Agriculture-Specific Models

대규모 데이터셋으로 사전 학습된 모델은 강력한 특징 추출 표현력을 바탕으로, 적은 양의 도메인 특화 데이터만으로도 높은 성능을 달성할 수 있다. 별도의 학습 없이도 다양한 객체를 정밀하게 분할할 수 있는 SAM(Segment Anything Model)은 농업 분야의 데이터 구축에 잠재력이 있다. Huang등은 YOLOv11이 탐지한 경계 상자를 프롬프트로 활용하여 SAM이 정확한 캐노피 마스크를 생성하도록 유도함으로써, 방대한 양의 수동 주석 데이터 없이도 IoU 0.924라는 높은 분할 정확도를 달성했다(Huang et al., 2025c). 또한, Li등은 SAM을 활용하여 기존에 탐지된 객체의 경계 상자로부터 픽셀 단위의 마스크 레이블을 자동으로 생성함으로써, 데이터셋 구축에 소요되는 시간과 비용을 절감했다(Li et al., 2025d). 다만, SAM과 같은 현재의 파운데이션 모델은 그 크기가 수백 메가바이트에서 수 기가바이트에 달해 현장 엣지 디바이스에 직접 배포하기 어렵다는 명확한 한계를 가지며, 이를 농업 환경에 맞게 경량화하고 최적화하는 연구가 병행되어야 한다.

Simulation and Digital Twin

실제 농업 현장에서 발생할 수 있는 모든 시나리오에 대한 데이터를 수집하는 것은 물리적으로 불가능에 가깝다. 시뮬레이션 환경은 이러한 데이터 수집의 한계를 극복하고, 로봇 알고리즘을 안전하고 효율적으로 학습 및 검증하기 위한 접근법의 핵심으로 평가되고있다. Lang등은 실제 온실의 환경 및 작물 데이터를 바탕으로 Unity 엔진을 이용해 고충실도의 3D 디지털 트윈 온실을 구축했다(Lang et al., 2025). 이 가상 환경은 토마토의 성장 과정을 실시간으로 시뮬레이션하며, 강화학습 모델이 수많은 시행착오를 거칠 수 있는 이상적인 훈련 및 실행 환경으로 사용되었다. 또한, Zhang등은 Rviz, Gazebo와 같은 시뮬레이터를 통해 로봇 팔의 움직임을 사전에 시각화하고, MATLAB을 이용해 다양한 수확 전략을 시뮬레이션함으로써 실제 실험 전 가장 효율적인 전략을 미리 검증했다(Zhang et al., 2025a). 더 나아가, Xu등은 유한 요소 분석(Finite Element Analysis, FEA)을 통해 사과가 충돌 시 받는 응력과 멍의 부피를 정량적으로 시뮬레이션함으로써, 실제 실험으로는 관찰하기 어려운 과일 내부의 손상 과정을 분석하는 데 성공했다(Xu et al., 2024).

End-to-End and Reinforcement Learning Paradigms

현재 대부분의 연구는 ‘인식-계획-제어’로 엄격하게 분리된 모듈식 접근법을 따르고 있으며, 이는 각 단계에서 발생하는 오차가 누적될 수 있다는 단점을 가진다. 이를 극복하기 위해, 센서의 시각 정보 입력으로부터 로봇의 모터 제어 신호까지를 단일 심층 신경망으로 연결하는 엔드투엔드(End-to-End) 학습 방식이 연구되고 있다. 로봇이 스스로 최적의 전략을 학습하는 강화학습(Reinforcement Learning)은 복잡하고 예측 불가능한 농업 환경에 매우 적합한 접근법으로 사료된다. 앞서 언급된 Lang등은 가상 온실 환경에서 DDPG(Deep Deterministic Policy Gradient) 강화학습 알고리즘을 훈련시켜 로봇이 주차 위치, 수확 순서, 타이밍 제어 등 복합적인 의사결정을 최적화하는 정책을 학습하도록 했다. 이 학습된 모델은 실제 로봇에 배포되어 수확 효율을 34.95% 향상시키는 성과를 보였다(Lang et al., 2025). 또한, Li등은 심층 강화학습(Deep Reinforcement Learning, DRL)을 적용하여 로봇 팔이 장애물을 피해 안전하게 목표물에 접근하는 방법을 스스로 학습하게 하는 등(Y. Li, Q. Feng, Y. Zhang, C. Peng, Y. Ma, et al., 2024), 강화학습은 인간이 명시적으로 프로그래밍하기 어려운 정교한 조작 기술을 데이터로부터 직접 습득하게 하는 강력한 도구임을 입증하고 있다.

Conclusion

본 논문은 전 세계 농업이 직면한 인구구조적 위기와 만성적인 노동력 부족 문제에 대응하기 위한 핵심 기술로서, 수확 및 선별 공정 자동화를 위한 컴퓨터 비전 기술의 연구 동향을 검토하고 분석하였다. 농업의 지속가능성 확보라는 목표 아래, 데이터 수집 전략부터 핵심 알고리즘의 개발, 그리고 실제 현장 배포를 위한 최적화에 이르기까지, 지능형 농업 시스템을 구성하는 기술적 파이프라인 전반을 조망하였다.

RGB 센서를 넘어 3차원 공간 정보를 제공하는 RGB-D 센서와 내부 품질까지 비파괴적으로 진단하는 분광 이미징 기술에 이르기까지, 데이터 수집 기술이 점차 다각화되고 있음을 확인하였다. 알고리즘 측면에서는, YOLO 계열의 1단계 탐지기가 실시간 성능을 바탕으로 현장의 표준으로 자리 잡았으며, Transformer 기반 아키텍처가 복잡한 환경에서의 강건성을 높이는 새로운 대안으로 연구되고 있음을 파악했다. 또한, 단순 2D 인식을 넘어 로봇의 정밀 조작을 가능하게 하는 3차원 인식 및 자세 추정 기술, 그리고 외관과 내부 품질을 종합적으로 평가하는 성숙도 추정 알고리즘이 기술의 고도화를 이끌고 있었다. 나아가, 이러한 고성능 모델들을 자원 제약적인 디바이스에서 구동하기 위한 효율적 아키텍처 설계, 모델 압축, 그리고 하드웨어 가속 기술이 실용화를 위한 필수적인 연구 구간임을 확인하였다.

그러나 이러한 괄목할 만한 기술적 진보에도 불구하고, 데이터의 희소성 및 표준화 부재, 예측 불가능한 현장 환경에 대한 강건성 부족, 시스템 통합 및 경제성 확보의 문제는 여전히 실용화를 위해 넘어야 할 중요한 과제로 남아있다.

결론적으로, 컴퓨터 비전 기술은 단순히 노동력을 대체하는 수준을 넘어, 농업 생산의 전 과정을 데이터 기반의 정밀하고 객관적인 의사결정 체계로 전환하는 디지털 전환(Digital Transformation)의 핵심 동력이다. 본 논문에서 제시된 기술적 성과와 향후 연구 방향들이 유기적으로 결합될 때, 컴퓨터 비전 기술은 인구 구조의 변화 속에서 농업의 지속가능성을 확보하고 미래 식량 안보에 기여하는 데 중추적인 역할을 수행할 것으로 기대된다.