Introduction

Materials and Methods

연구 지역 및 개화기 조사 방법

드론 영상 촬영 및 영상 전처리

영상 분석

상대 개화율 추정

Results and Discussion

개화기 조사 결과

드론 정사 영상 합성 결과

식생지수기반 과수 개화 탐지

Geo-SAM 기반 과수 개화 탐지

개화 탐지 면적 기반 상대 개화율 추정

Conclusions

Introduction

개화기는 과수의 결실과 수량을 결정하는 핵심단계이다. 기후변화로 따른 겨울철 기온 상승으로 인한 개화기 조기화, 꽃가루와 방화곤충 부족으로 수분 수정 불량으로 결실량 감소 피해가 발생할 수 있다. 또한 개화 기간에 이상저온이 발생하면, 꽃봉오리가 얼어붙는 냉해 피해가 나타날 수 있으며 개화된 꽃에 인공수정이 어렵고 어린 열매의 발육부진으로 이어질 수 있다(Kim and Kim, 2018). 따라서 개화 시기를 예측하고 정확한 개화 상태를 모니터링하는 것은 과수 안정생산을 위해 필수적이다. 발아기, 개화기, 만개기 등 봄철 과수 생물계절을 예측하는 방법으로 기상 관측자료를 활용한 휴면시계 모형, 적산온도 모델 등이 활용되고 있다(Jang et al., 2002; Jeong et al., 2023; Kim et al., 2009). 하지만 이러한 모델은 특정 지역의 기후에만 적용 가능하다는 단점이 있으며, 해당 지역에 대한 기상관측소 기상자료와 더불어 꽃눈 발달 단계 및 개화율에 대한 현장 조사 자료에 크게 의존한다(Kim et al., 2020).

이에 따라 최근 드론 영상 기반 원격탐사가 새로운 대안으로 주목받고 있다. 드론을 활용하여 원하는 시기의 영상 자료를 수집할 수 있으며, 과수원과 같은 들녘 단위(100~1,000ha)의 필지의 영상 자료를 10cm 이내의 높은 공간해상도로 확보할 수 있다(Lee et al., 2015). 식물체 엽록소의 분광반사특성을 이용하여 드론 다중분광 영상의 파장을 조합한 식생지수로써 식물체의 생육특성을 평가에 사용되어 왔다(Tomas and Gausman, 1977). 특히 정규화 식생지수인 NDVI(Normalized Difference Vegetation Index)를 활용하여 식생의 생체량, 엽록소 함량, 질소량 추정 등 널리 활용되고 있다(Jordan, 1969). 또한 아몬드 과수원이나 들녘 필지의 Halerpestes tricuspis(미나리아 재비과)의 개화를 탐지하기 위해 고해상도의 드론영상을 수집하고, EBI(Enhanced Bloom Index), HFI(Hyperspectral Flower Index)과 같은 지수를 개발 및 활용하여 식생과 섞여 있는 꽃을 탐지하였다(Chen et al, 2009; Chen et al., 2019).

과수 개화를 정밀 분류하기 위해 RGB 영상과 딥러닝 기반의 객체 인식 기법을 이용한 연구가 진행되고 있다(Zhang et al., 2021). Dias et al.(2018)은 사과, 배, 복숭아 등 다양한 과수에서 자율주행 로봇으로 촬영한 RGB 영상을 활용하여, 잔차 합성곱 신경망(residual convolutional neural network; CNN)과 세밀 세분화(refined semantic segmentation) 네트워크를 적용하여 개화를 탐지하였다. 아몬드 과수의 드론 영상을 대상으로 U-Net 딥러닝 구조를 활용하여 꽃의 개화를 탐지하고, 수량을 예측하였다(Chakraborty et al., 2023; Popescu et al., 2023). Zhao et al.(2024)은 드론 영상과 YOLO 알고리즘을 이용하여 블루베리 열매를 탐지하는 연구를 수행하여, 과수원 작황 모니터링과 생산성 추정의 자동화를 제시하였다. 이러한 딥러닝 알고리즘을 활용한 선행연구들은 객체를 박스 형태로 탐지하여 위치를 매핑하는 방식으로 수행되었다. 그러나 과수 개화율을 정밀하게 탐지하기 위해서 객체의 형상을 분류해야 한다. 최근 객체 윤곽선 기반의 실시간 대화형 분할 모델인 SAM(Segment Anything Model)은 다양한 객체의 형태를 분할할 수 있는 범용 딥러닝 모델로써, 객체 분류 연구에 활용되고 있다(Zhao et al., 2023; Kim et al., 2025; Song et al., 2025).

본 연구의 목적은 드론 영상을 활용하여 배 과수의 개화율을 정량적으로 추정하는 방법론을 제시하는데 있다. 이를 위해 (1) 드론 RGB 및 다중분광 영상을 활용하여 개화 시기별 영상을 취득하고, (2) 식생지수 및 SAM 기반 분할 기법을 적용하여 배꽃을 탐지·분류하며, (3) 탐지된 영상 기반 결과를 현장 개화율 조사와 비교하여 영상 기반 개화율 추정의 가능성과 한계를 평가하였다.

Materials and Methods

연구 지역 및 개화기 조사 방법

본 연구는 전라남도 나주시에 위치한 국립원예특작과학원 배 연구센터(35°1′25″N, 126°44′44″E)와 전북특별자치도 완주군에 위치한 과수기초기반과(35°49′42″N, 126°1′46″E)의 배 과수 시험포장에서 수행되었다. 두 시험포장 모두 Y자 수형을 적용하여 가지가 평면으로 배치하여 주간 4m, 열간 6m의 재식간격으로 밀식 재배가 이루어지고 있다. 시험 품종은 신고(Niitaka) 품종으로 각 시험포장 내 꽃눈, 수관 등 생육상태가 평균적인 대표 개체로써 3 그루를 분석대상으로 선정하였다. 선정한 각 분석 과수의 위치식별을 위하여 주변에 GCP(Groun Control Point)를 설치하여 라벨링하였다. 개화기 조사는 만개기 전후로 4차례 드론 촬영 시기와 일치하도록 하였다. 조사 방법은 분석 과수에 대해 농업과학기술 연구조사분석기준에 따라 수행하였으며 전체 꽃눈과 개화된 꽃의 개수를 비율로서 개화율(%)을 산정하였다. 이때, 전체 꽃눈 중 약 70~80% 개화가 나타날 경우, 만개기로 판단하였다(RDA, 2012).

드론 영상 촬영 및 영상 전처리

드론 영상 촬영은 회전익 드론 M300(DJI, China)에 다중분광 카메라 RedEdge-MX(Micasense, USA) 및 RGB 카메라 (Zenmuze P1, China)을 장착하여 수행하였다. 다중분광 카메라를 통해 가시광선(Red, Green, Blue), 적색 경계(Red Edge), 근적외선(NIR, Near Infrared) 총 5개 파장대역에 대해 영상을 획득하였으며, 촬영 시기별 비행정보는 Table 1과 같다. 약 3 cm의 배꽃을 촬영하기 위해 촬영 고도를 RGB 영상 40 m, 다중분광 영상 30 m로 설정하여 각각 약 0.5 cm 및 1 cm의 공간해상도(GSD, Ground Standard Distance)를 확보하였고, 경로 중복도는 종횡 모두 80%로 설정하였다. RGB영상의 경우, 딥러닝 기반의 픽셀단위의 객체 분류를 위해 높은 공간해상도를 요구하기 때문에 다중분광영상보다 높은 공간해상도를 확보하였다. 드론 비행 속도는 3 m/s로 유지하였으며, 촬영은 맑음 또는 약간의 구름이 있는 날씨에서 수행되었다. 영상 촬영 전에는 반사보정패널(CRP, Calibration Reflectance Panel)을 이용하여 반사도 보정을 수행하였다. 촬영된 개별 다중분광, RGB 영상은 각각 Metashape(Agisoft, Russia)와 Pix4D Mapper(Pix4D, Switzerland)를 활용하여 GeoTIFF 형식인 정사영상으로 합성하였다.

Table 1

UAV flight schedule and weather conditions during flowering survey.

영상 분석

식생지수

지리정보시스템(Geographic Information System, GIS) 프로그램인 QGIS(ver.3.34.8)를 활용하여 드론 다중분광 영상을 기반으로 식생지수 산출하였다. Table 2와 같이 본 연구에서 사용한 분석 지수로는 식물체 생육 진단에 널리 활용되는 NDVI와 밝은 흰색 꽃 탐지에 특화된 EBI를 적용하였다. NDVI는 적색광과 근적외선의 반사율 차이를 이용하여 엽록소 함량 및 식생 활력도를 평가할 수 있고(Jordan, 1969), EBI는 RGB 반사율의 조합과 보정을 통해 토양 및 식생과 구분되는 꽃의 높은 반사 특성을 평가할 수 있다(Chen et al., 2009; Atanasov et al., 2024).

분석 지수의 배꽃 탐지 가능성을 평가하기 위해 과수 개별 영역의 식생지수 평균을 추출하여 개화에 따른 시계열 식생지수 변화를 분석하였다. 본 연구에서는 개화율 추정을 위해 개화 여부를 탐지해야 하며, 식생지수의 시계열 변화를 통해 개화 탐지에 적절한 지수를 도출하여 임계값 기반 탐지를 수행하였다.

Table 2

Vegetation indices applied in this study.

| Index | Equation |

|

NDVI (Normalized Difference Vegetation Index, Jordan, 1969) | |

|

EBI (Enhanced Bloom Index, Chen et al., 2009) |

Geo-SAM (Geometry Segment Anything Model)

QGIS 프로그램의 상용 플러그인인 Geo-SAM(Geometry Segment Anything Model)을 이용하여 드론 RGB 영상기반 과수의 배꽃을 탐지 및 분류하였다. Geo-SAM은 SAM을 기반으로 하여 영상 내 객체의 경계를 자동으로 추출할 수 있으며, 포인트(point) 또는 박스(box) 형태의 사용자 입력에 따라 관심영역의 객체를 대화형으로 분류할 수 있는 장점이 있다(Zhao et al., 2023). 본 연구에서는 개화된 꽃무리에 박스 형태의 경계를 지정하여 배꽃 객체를 탐지하였으며, 잘못 분류된 객체는 실시간으로 제거 및 수정하여 정확도를 높였다. 탐지된 객체는 Polygon vector 형식(Shapefile)으로 저장하였다. QGIS의 속성테이블을 활용하여 각 객체의 면적을 산출하여 정사영상내 배꽃의 총 면적을 계산하였다.

상대 개화율 추정

드론 영상 기반 딥러닝 및 식생지수 분석 결과는 배꽃 무리를 탐지된 면적으로 산출할 수 있으나, 탐지된 면적을 통해 개별 꽃, 꽃눈의 개수를 계수하기에 한계가 있다. 또한 탐지된 면적과 꽃의 개수를 비교하기 적합하지 않았다. 이에 본 연구에서는 만개기의 현장 조사 결과를 기준으로 만개기와 중간 개화기의 탐지면적을 비교하여 중간 개화기의 상대적인 개화율을 추정하였다. 중간 개화기의 개화율()은 만개기의 개화율()을 기준으로 두 시점의 탐지 면적(, ) 비율을 곱하여 산출하였다. 추정한 상대 개화율은 결정계수(R2)와 평균제곱근오차(Root Mean Square Error, RMSE)를 활용하여 개화기 조사 결과와 비교하였다.

이때, , 는 개화 중간시점인 2025년 4월 8일의 배 과수의 개화율(%)과 탐지면적(m2)을 나타내며, , 는 만개기인 2025년 4월 10일의 개화율(%)과 탐지면적(m2)을 의미한다.

Results and Discussion

개화기 조사 결과

Table 3은 나주 배연구센터와 완주 과수기초기반과의 개화기 조사 결과로써 조사기간별 개화율을 나타낸 결과이다. 2025년 4월 4일의 경우, 개화 전 시기로 두 시험포장의 모든 분석과수의 개화율이 0%로 나타났다. 4월 8일의 경우, 나주 배연구센터의 분석과수의 개화율은 15~50%로 나타났으며 완주 과수기초기반과는 25~55%로 나타났다. 나주 배연구센터와 완주 과수기초기반과의 시험포장의 ‘신고’ 품종에 대한 만개기는 각각 4월 10일, 4월 9일로 나타났으며, 4월 10일의 분석과수 개화율은 각각 50~80, 70~90%로 나타났다. 만개기 이후 드론 촬영 시기인 4월 15일, 16일은 낙화가 진행되어 개화율을 산정하지 않았다.

Table 3

Flowering rate by analysis tree and test field.

| 2025/4/8 | 2025/4/10 | |

| Naju | 50% | 80% |

| 15% | 50% | |

| 30% | 60% | |

| Wanju | 55% | 90% |

| 55% | 90% | |

| 25% | 70% |

드론 정사 영상 합성 결과

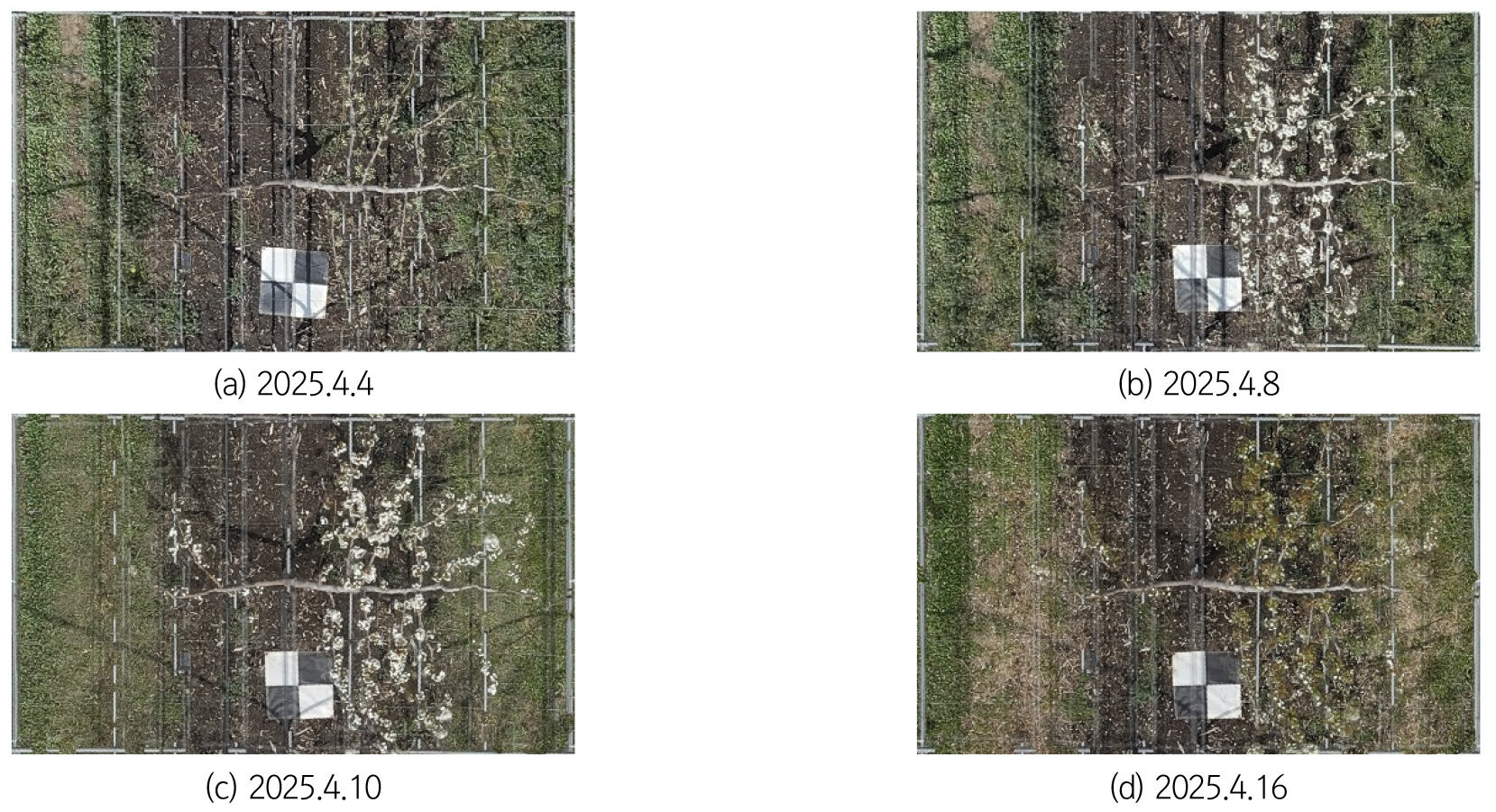

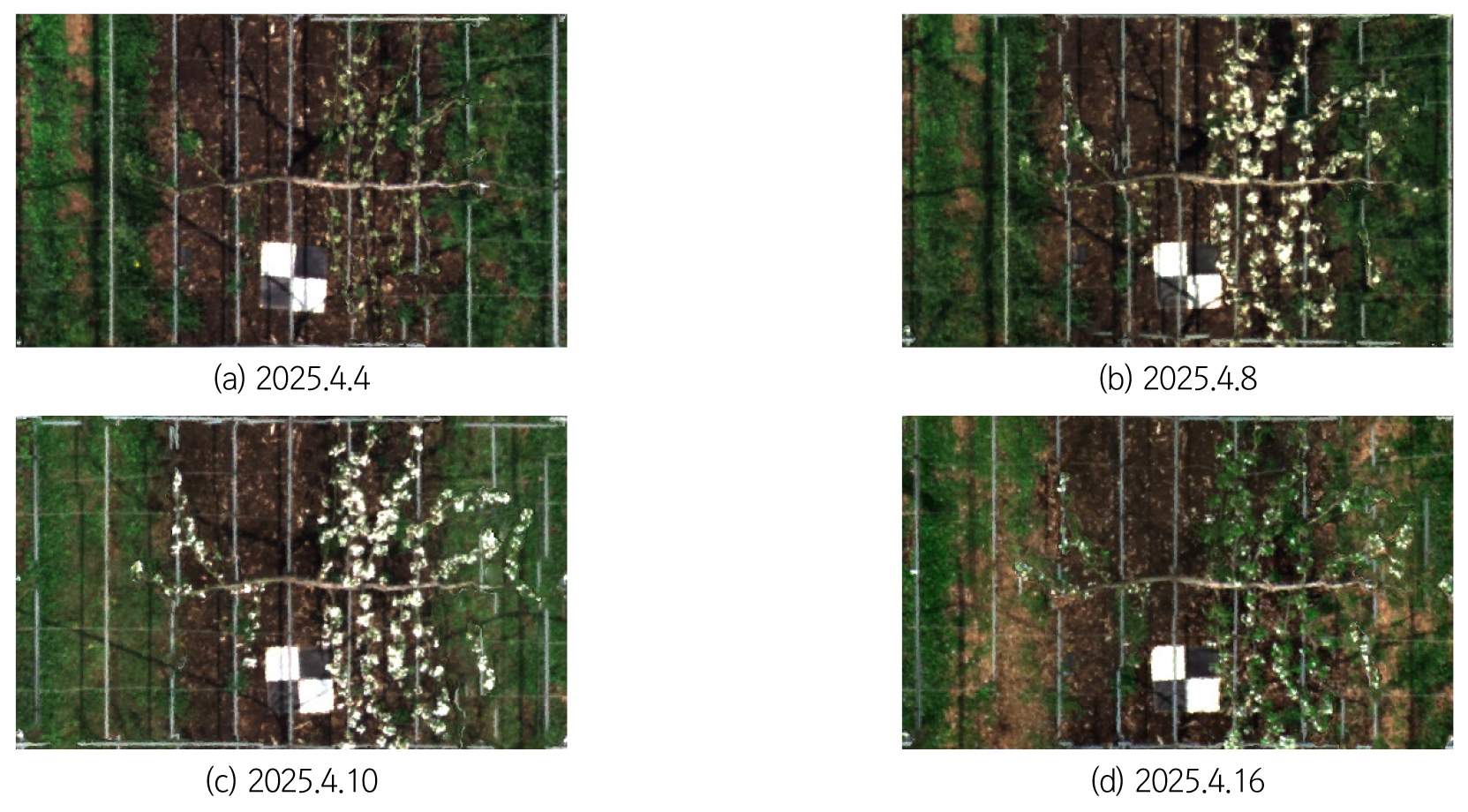

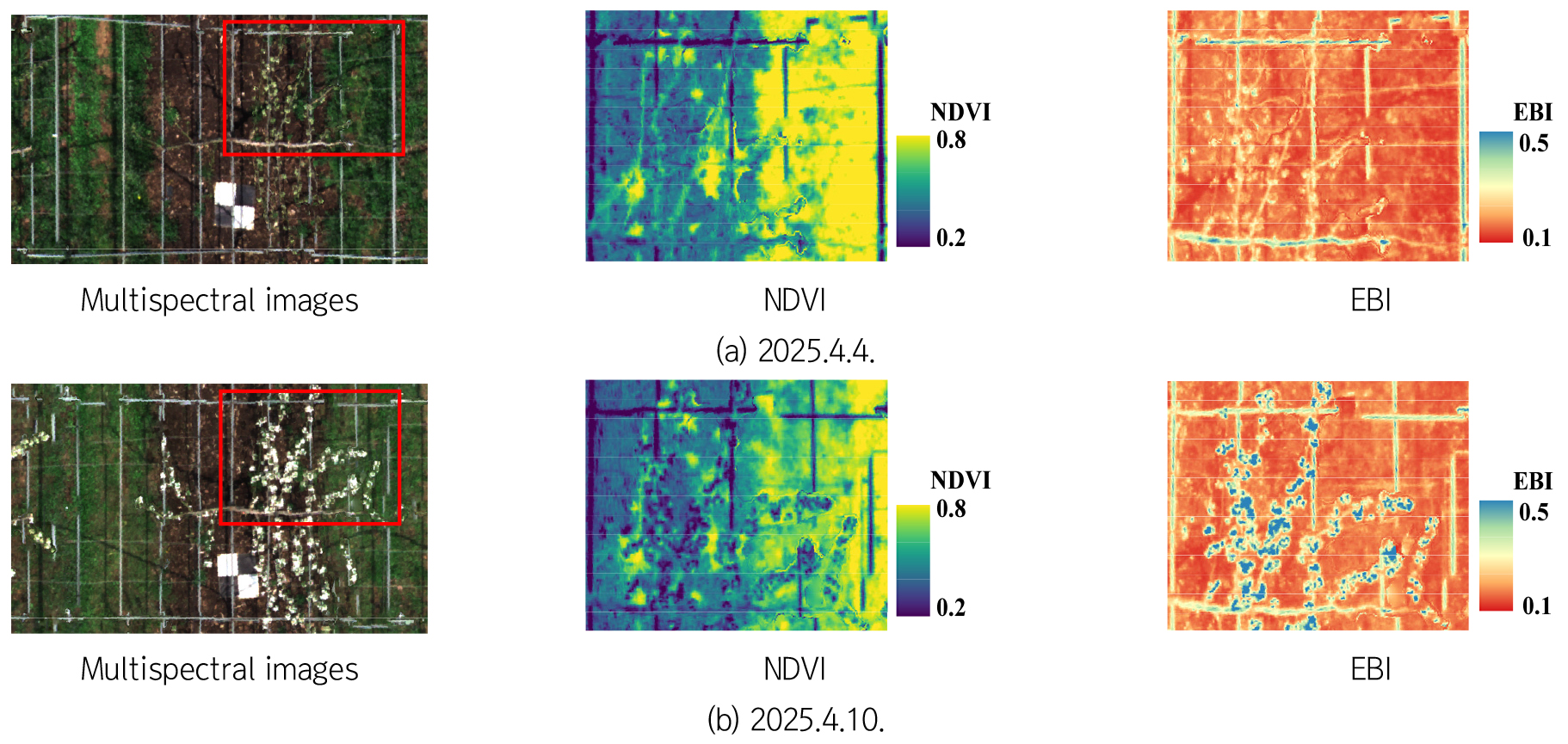

Figs. 1, 2는 나주 배연구센터의 분석 대상 과수를 드론 영상을 정사합성하여 시계열로 나타낸 결과이다. 2025년 4월 4일의 경우, 개화 전 시기로 꽃눈은 확인되었으나 RGB 및 다중분광 영상에서 모든 꽃눈을 개별적으로 계수하기는 어려웠다. 4월 8일의 경우, 개화가 시작되는 단계로 RGB 영상에서는 꽃무리와 꽃눈이 혼합된 양상이 나타났으며, 다중분광 영상 또한 불균일한 개화 분포가 나타났다. 4월 10일의 경우, 만개기로 몇 개의 꽃눈을 제외한 대부분의 꽃무리들이 식별되었으며, 4월 8일에 나타난 꽃무리의 크기가 증가하였다. 이때 RGB 영상은 높은 공간해상도로 꽃 객체 탐지가 용이하였으나, 하얀색을 띠는 토양 부산물이 함께 나타나 탐지를 혼동시킬 수 있었다. 반면 다중분광 영상은 공간해상도는 낮았으나, 배꽃이 다른 배경(토양·식생) 대비 높은 반사율을 보여 RGB 영상보다 상대적으로 명확한 구분이 가능하였다. 4월 16일은 만개 이후로 꽃이 대부분 지고 잎이 성장하는 시기로, RGB, 다중분광영상 모두에서 꽃보다 잎의 반사 특성이 나타났다.

한편, RGB와 다중분광 영상 모두에서 철제 프레임 및 가지가 불연속적으로 합성되는 현상이 나타났다. 이는 드론 영상 정사합성 과정에서 공중에 있는 물체(철제 구조물, 수관)의 합성이 상대적으로 어렵다는 것을 나타내며, 정사합성 품질이 배꽃 탐지 정확도에 영향을 줄 수 있음을 시사한다.

식생지수기반 과수 개화 탐지

Fig. 3은 드론영상 내 철제 프레임, 토양 잔재물 등 외부 요인을 최소화하면서 식생지수 변화를 탐지할 수 있는 과수 분석의 영역을 나타낸다. 분석 과수의 가지에서 30 cm buffer 레이어로써 생성되며 각 분석 과수별 식생지수 평균값을 개화 시기별로 추출하였다.

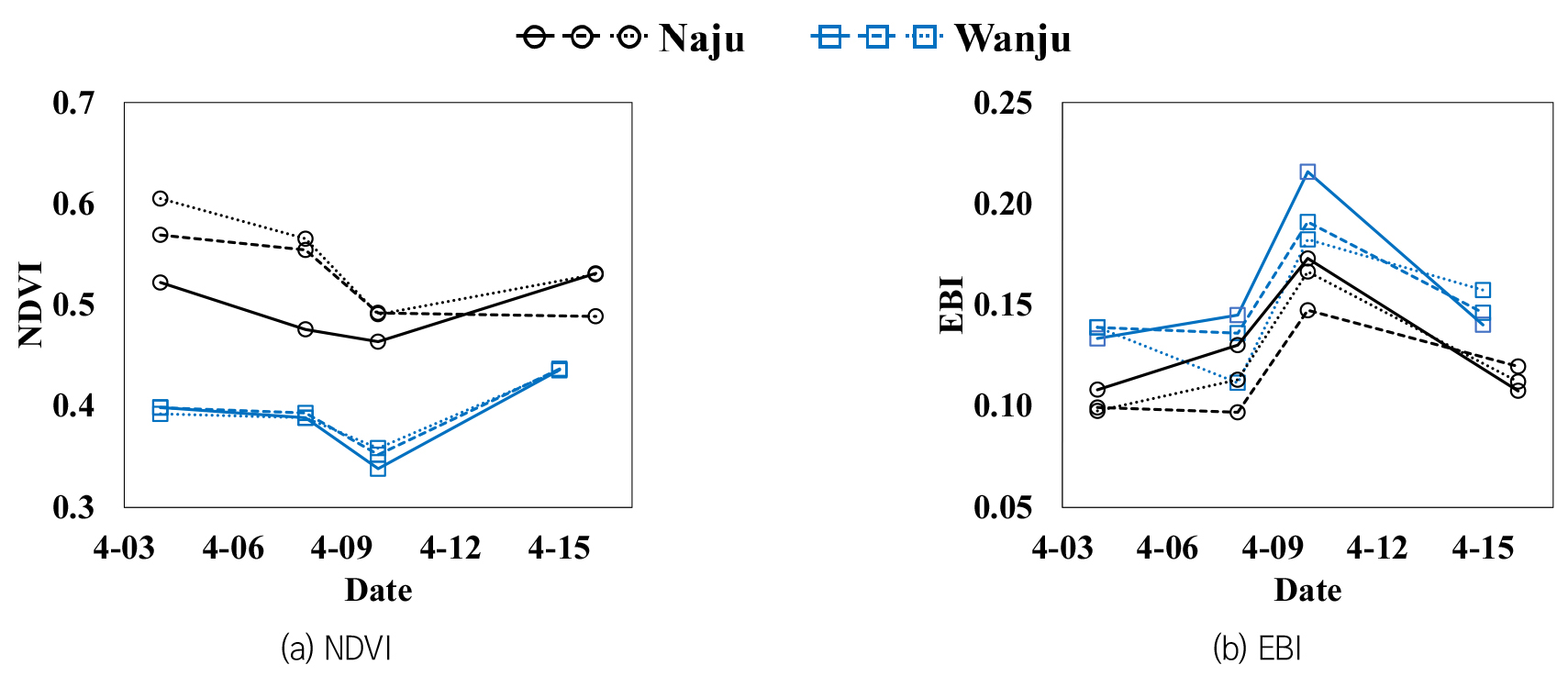

Fig. 4는 드론 다중분광영상 기반으로 산출한 NDVI와 EBI를 시계열 분석한 결과이다. 두 시험포장, 모든 분석과수 모두 2025년 4월 4일부터 만개기인 10일까지 NDVI가 지속적으로 감소하였다. 이는 개화가 진행되면서 배꽃이 배경 잡초와 같은 식생을 가렸고, 낙화되기 전인 10일에서 각 분석과수별로 NDVI가 최소값으로 나타났다. 또한 나주 배연구센터의 일부 분석과수를 제외한 모든 분석과수에서 만개기 이후 낙화가 이루어지면서 잎이 성장하면서 NDVI가 증가하였다. EBI의 경우, 모든 분석과수에 대해 4월 4일부터 8일까지 증가하지 않았지만, 모든 분석과수의 EBI가 만개기인 10일에 최대값을 나타냈으며 이후 감소하였다. 철제 프레임, 배경 등 과수 이외의 영향을 감소시키는 것을 목표로 하였지만, 다중분광영상의 합성 과정에서 철제프레임, 과수, 배꽃 등 위치적 오차로 인해 분석과수별로 다른 양상을 나타낸 것으로 판단되었다.

Fig. 5는 나주 배연구센터 분석과수에 대한 개화 시작(4월 4일)과 만개기(4월 10일)의 다중분광 영상과 동일 시점의 NDVI·EBI 공간분포를 비교한 것이다. NDVI는 토양(0.2~0.4)과 배꽃(0.1~0.3)의 값 범위가 중첩되어 배경에 따라 분리가 어려웠다. 반면 EBI는 식생·토양 배경이 0.1 이하로 낮은 반면 배꽃은 0.3 이상으로 선명하게 분리되어, 위치와 배경에 관계없이 일관된 증가 패턴을 보였다. 즉, 개화 단계별 공간분포 확인에는 NDVI보다 EBI가 유리함을 확인하였다.

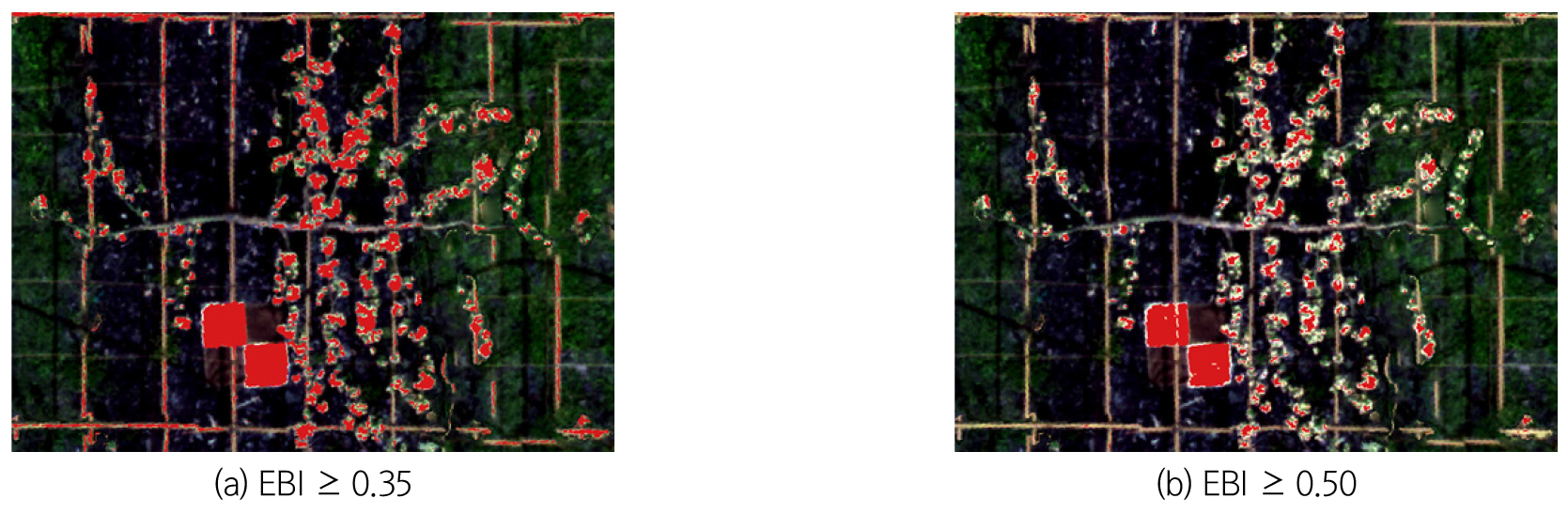

Fig. 6는 2025년 4월 10일 만개기에 촬영된 다중분광 영상에서 EBI 임계값을 적용하여 배꽃 탐지면적을 추정한 결과이다. 0.35 이상의 낮은 임계값을 설정한 경우, 배꽃 무리 전체가 비교적 잘 탐지되었으나, 철제 프레임과 같이 반사율이 높은 비목표 객체 또한 탐지되는 한계가 있었다. 반대로 0.50 이상의 높은 임계값을 설정할 경우, 외부 요인에 의한 오탐지는 감소하였으나, 꽃무리의 중심만이 탐지되어 전체 개화 면적을 충분히 반영하지 못하였다. 이러한 결과는 EBI 기반 배꽃 탐지에서 임계값 설정이 탐지 정확도와 민감도에 큰 영향을 미치며, 개화율 추정의 핵심 변수로 작용할 것으로 판단하였다.

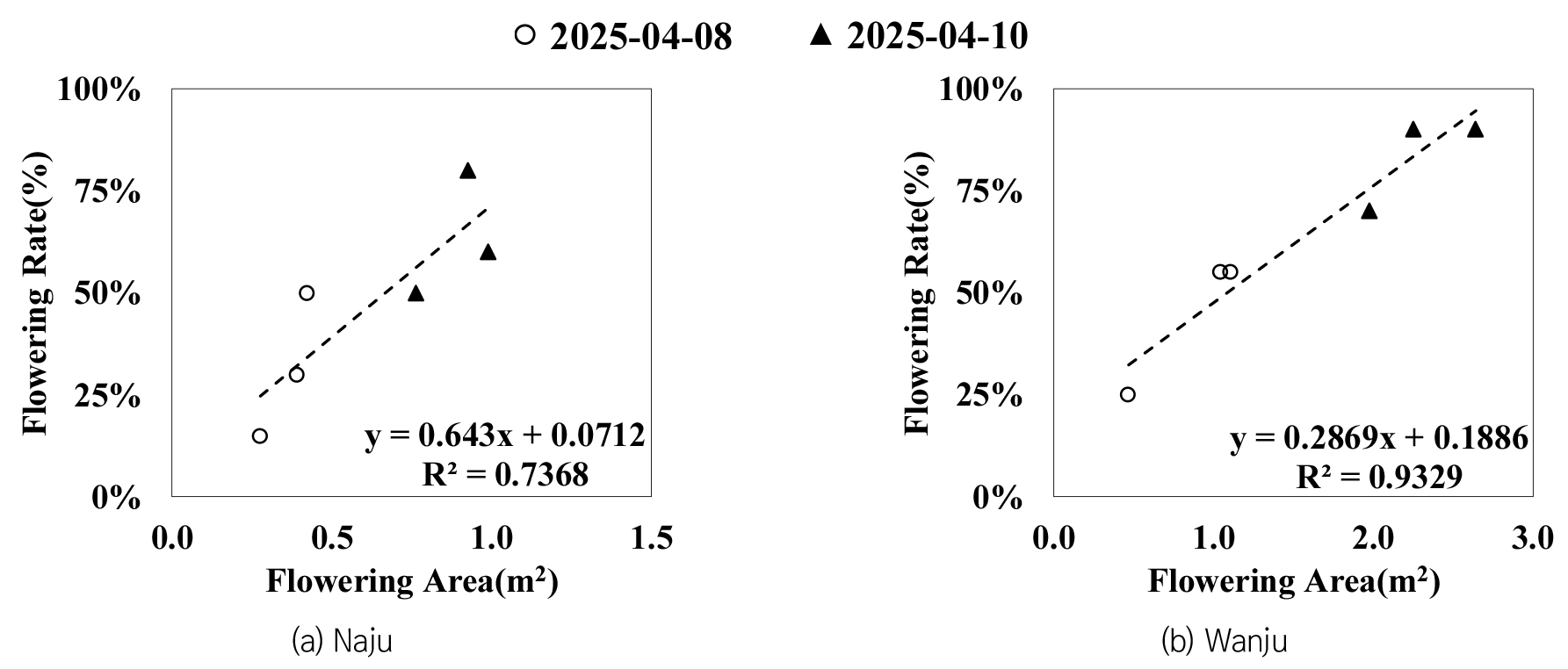

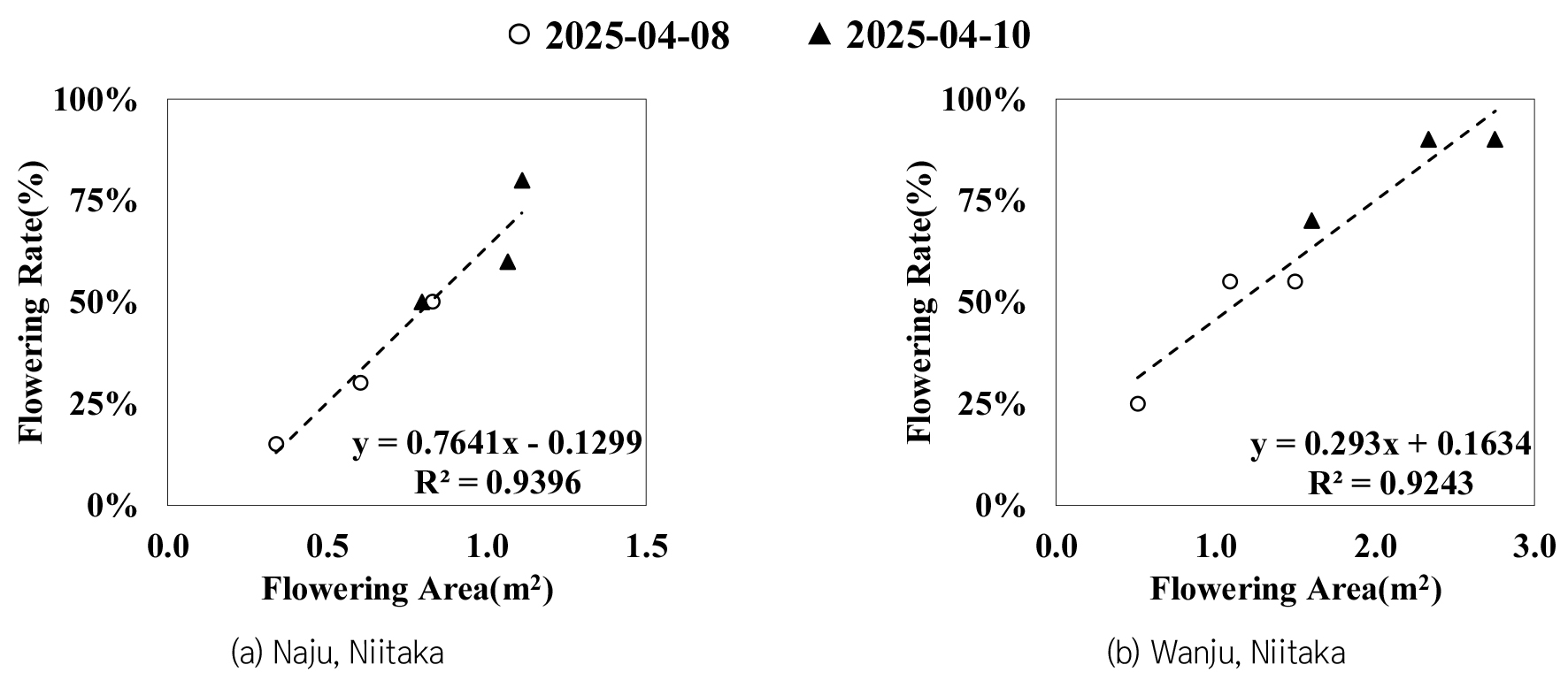

본 연구에서는 EBI 임계값을 꽃무리 전체 면적을 탐지할 수 있는 0.35 이상으로 설정하였다. Fig. 7은 EBI임계값 기반으로 산출된 배꽃 탐지 면적과 현장 개화율 조사 결과를 비교한 결과이다. 나주 배연구센터의 경우, 낮은 설명력(R2 = 0.737)이 나타났지만, 완주 과수기초기반과의 결정계수는 0.933로 높은 설명력이 나타났다. 또한, 나주 배연구센터의 경우, 개화 면적이 0.28~0.99 m2, 완주 과수기초기반과의 경우 0.47~2.64 m2로 나타났으며, 이는 필지, 과수마다 가지의 배열, 꽃눈의 개수, 분포 정도에 따라 개화 면적의 차이를 나타냈다. 따라서 선형회귀분석을 통한 탐지 면적과 개화율의 1:1 비교는 적절치 않은 것으로 판단되었다. 또한 필지의 모든 과수를 분석한 것이 아닌 시험포장별 3그루의 과수만 분석하였기 때문에 추가적인 분석이 요구된다.

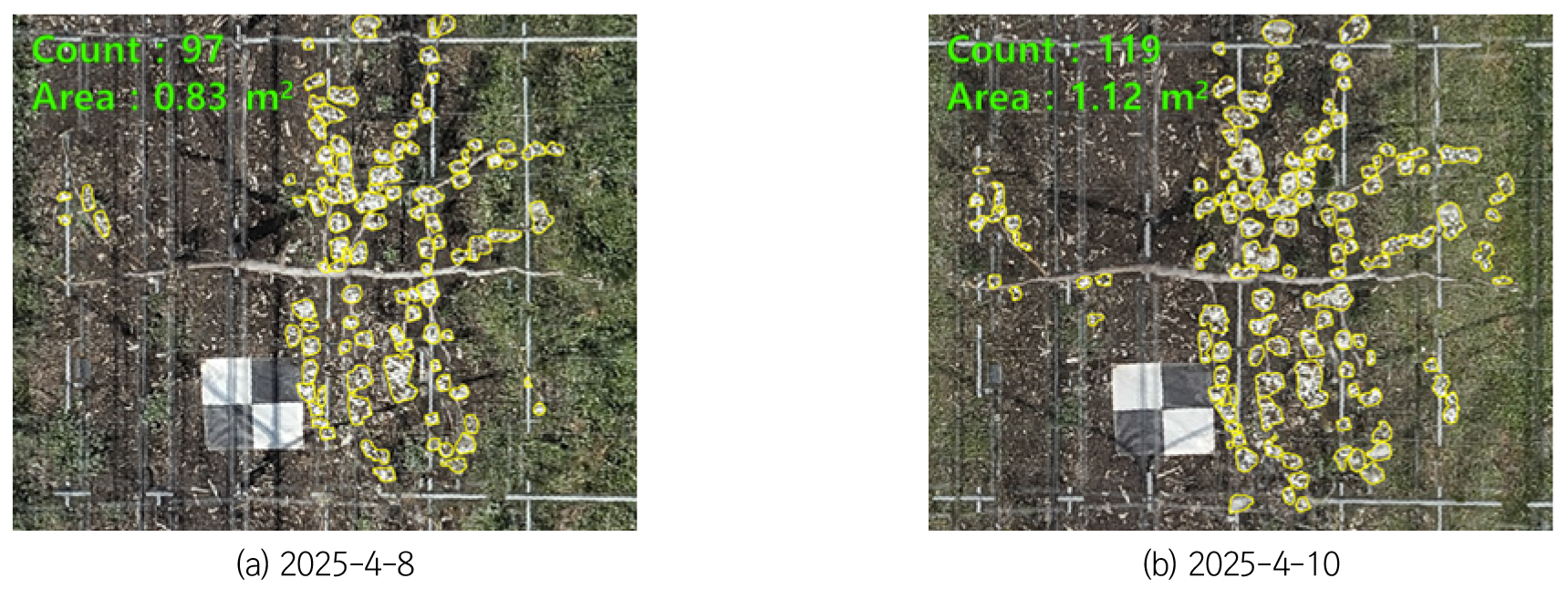

Geo-SAM 기반 과수 개화 탐지

Fig. 8은 나주 배연구센터 분석과수를 대상으로 드론 RGB 영상을 이용하여 Geo-SAM 패키지를 이용하여 탐지한 배 개화를 나타낸다. 2025년 4월 8일 드론 영상에 비해 4월 10일 드론 영상에서의 경우, 개화가 진행되면서 탐지된 꽃무리의 개수와 면적이 증가하였다. 이러한 결과는 다른 과수에 대해서도 같은 양상으로 나타났으며, 이는 현장 개화율 조사 결과와 유사한 경향으로 나타났다.

Fig. 9은 드론 RGB 영상을 Geo-SAM 패키지를 이용하여 탐지한 개화 면적과 현장 개화율 조사 결과를 비교한 결과이다. 나주 배연구센터와 완주 과수기초기반과의 분석과수에 대한 결정계수는 각각 0.940, 0.924으로 나타났다. 이는 Geo-SAM 패키지를 통한 개화탐지가 영상합성과정에서의 오류나 구조물 및 배경혼입을 최대한 제거한 결과라고 판단되었다. 다만 Geo-SAM은 대화형 방식으로 사용자가 직접 박스나 포인트를 지정하여 분류하기 때문에, 탐지 결과는 사용자의 숙련도와 입력 방식에 따라 달라질 수 있는 한계가 있다. 또한 하나의 필지 전체 개화를 전수 조사하기 위해 시간과 노동력이 과도하게 소요되어 실용성이 떨어질 수 있다. 따라서 Geo-SAM 기반 탐지는 전체 과수원 개화율 추정보다는 표본 구간의 보정이나 보조적 활용에 적합한 도구로 판단된다.

개화 탐지 면적 기반 상대 개화율 추정

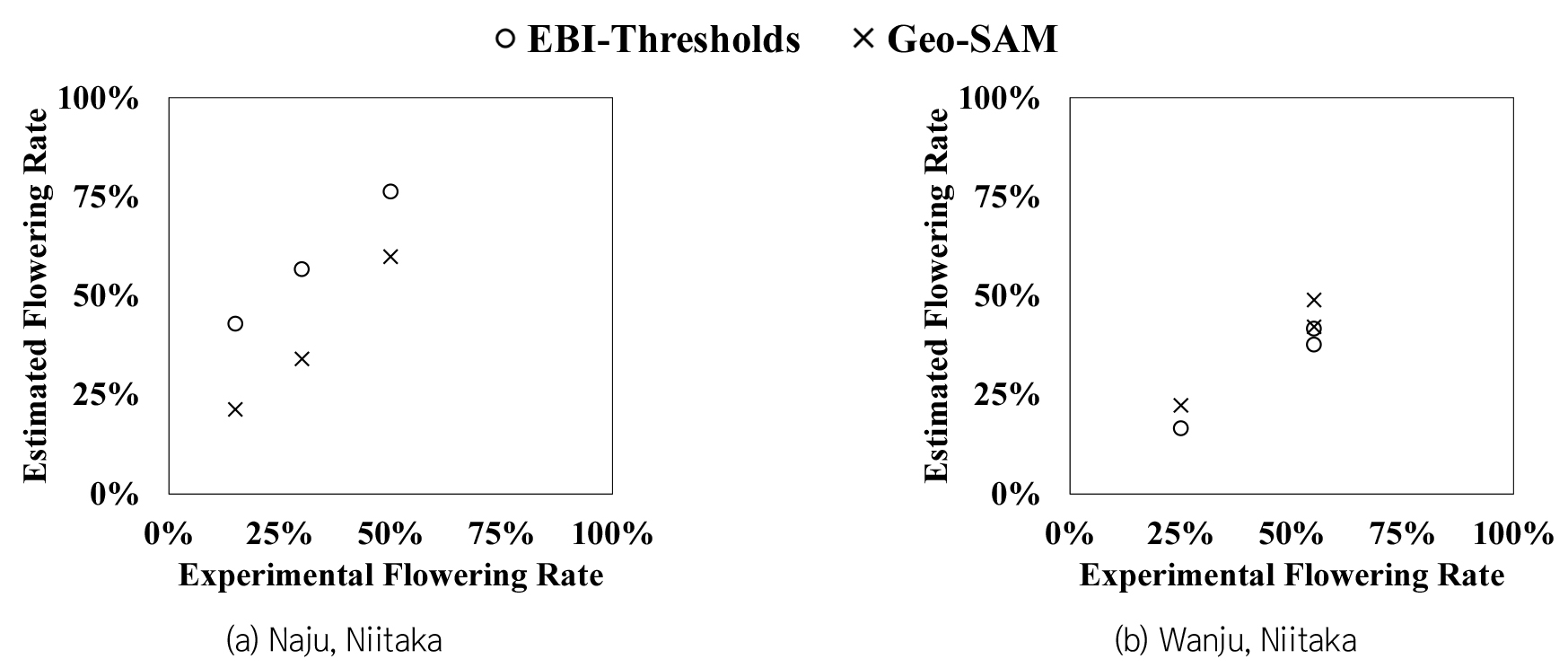

Fig. 10은 EBI 임계값과 Geo-SAM 기반 탐지면적을 활용하여 추정한 상대 개화율과 현장조사 개화율을 비교한 결과이다. 모든 시험포장과 개화 탐지 기법에 대해 일정 수준 이상의 설명력(R2 ≥ 0.94)을 나타내었지만 시험포장별로 과대, 과소추정되는 경향이 나타났다. 나주 배연구센터에서 EBI 기반 추정된 상대 개화율의 경우, RMSE가 27.0%로 큰 오차를 보였으나, SAM 기반의 경우 RMSE가 7.1%로 현장조사 개화율과의 차이가 작았다. 완주 과수기초기반과의 경우, EBI과 Geo-SAM기반 추정된 상대 개화율의 RMSE가 각각 13.5%, 8.3%로 나타났다. Geo-SAM 기반 분석이 EBI보다 높은 정확도를 보였다. 하지만 실시간 대화형태인 Geo-SAM 기반 분석보다 EBI의 경우, 영상 지수 기반으로 단순하고 신속하게 개화 정도를 정량화할 수 있다는 점에서 핵심적인 기법으로 활용 가능하다고 판단되었다. 하지만, 낮은 EBI 임계값을 설정함으로써, Fig. 5와 같이 배꽃뿐만 아니라 철제 프레임과 같이 배꽃과 높은 반사율이 나타나는 외부 요인 또한 탐지되며 임계값 설정에 따라 상대 개화율 추정의 정확도가 좌우될 것으로 판단되었다. 정확도 향상과 품종 및 지역 확장을 위해 다양한 개화단계에서 반복 검증을 통해 보편적인 추정식과 자동화된 보정 절차를 마련하는 것이 중요하다고 판단된다.

Conclusions

최근 기후변화로 인해 과수 개화기의 기온 변동성이 심화되면서, 개화 시기의 조기화나 이상저온 발생으로 인한 결실 불량·낙화 피해가 증가하고 있다. 이에 따라 과수 개화기를 정밀하게 모니터링하는 것은 안정적인 과수 생산을 위해 필수적이다. 이에 본 연구는 드론 기반 다중분광 영상과 RGB 영상을 활용하여 식생지수 및 딥러닝 기반의 배 과수의 개화율을 상대적으로 추정하고, 현장 조사와 비교하여 영상 기반 개화율 추정의 가능성과 한계를 평가하였다.

식생지수 기반 분석의 경우, NDVI는 배꽃과 토양·잡초 배경의 값이 중첩되어 개화 탐지에 한계가 있었으나, EBI는 개화기에 뚜렷하게 증가하며 배꽃의 반사 특성을 효과적으로 반영하였다. Geo-SAM 기반 탐지는 RGB 영상의 개화를 실시간 대화형으로써 탐지할 수 있었으며, 영상 합성과정에서 발생할 수 있는 오류나 배경 혼입을 효과적으로 줄이는 장점을 나타냈다.

개화기 조사 결과의 만개기 개화율을 활용하여 EBI와 Geo-SAM을 기반 상대 개화율을 추정하였다. EBI기반 추정된 상대 개화율의 RMSE는 13.5~27.0%로 나타났으며, Geo-SAM기반 추정 상대 개화율의 RMSE는 7.1~8.3%로 나타났다. EBI의 경우, 배꽃의 높은 분광특성을 빠르게 반영할 수 있으며, Geo-SAM의 경우, 실시간 대화형 탐지를 통해 배꽃 이외의 외부요인을 제거하여 정확도가 높았다.

본 연구에서는 신고 품종과 단일 수형 조건에서 도출된 결과이므로 다른 품종 및 수형에 대한 분석이 필요하며, 향후 EBI와 Geo-SAM을 병행활용하여 정사영상 합성, 임계치 설정 및 추정식 설계 등 분석 방법의 고도화가 이루어질 예정이다. 또한 본 연구의 접근법은 과수원의 개화 모니터링, 수량 예측, 나아가 기후변화 대응형 과수 생육관리의 핵심 기술로 발전할 수 있을 것이다.